2026-05-15 08:55:30

最近中文互联网圈突然出现了一个很有意思的账号,叫“耿同学讲故事”,跟“老范讲故事”很像。人家叫“耿同学讲故事”,这是一个科普博主,最近突然就火了。

他不是靠娱乐八卦火的,也不是靠直播带货火的,也不是靠情绪鸡汤火的。他火起来,是因为他连续质疑高校论文的问题。而且这些论文不是普通的课程论文,也不是学生作业,而是涉及高校院长、国家杰出青年、长江学者,以及生物医学顶刊论文。他就找这个最大号的去怼。

他抓住的论文,有些是在 Nature 上,有些是 Nature Cancer 子刊,有些是 Nature Cell Biology 子刊,还有 Nature Nanotechnology,以及 Nature Nanotechnology 子刊上的,都是这类顶刊上的论文。

这个事情为什么会出圈呢?以前质疑论文、质疑学术造假的人也是存在的,但是当时很多院校其实是不理你的。你质疑你就质疑,我坚决不理你。但是这次因为有人理了,所以他就出圈了。

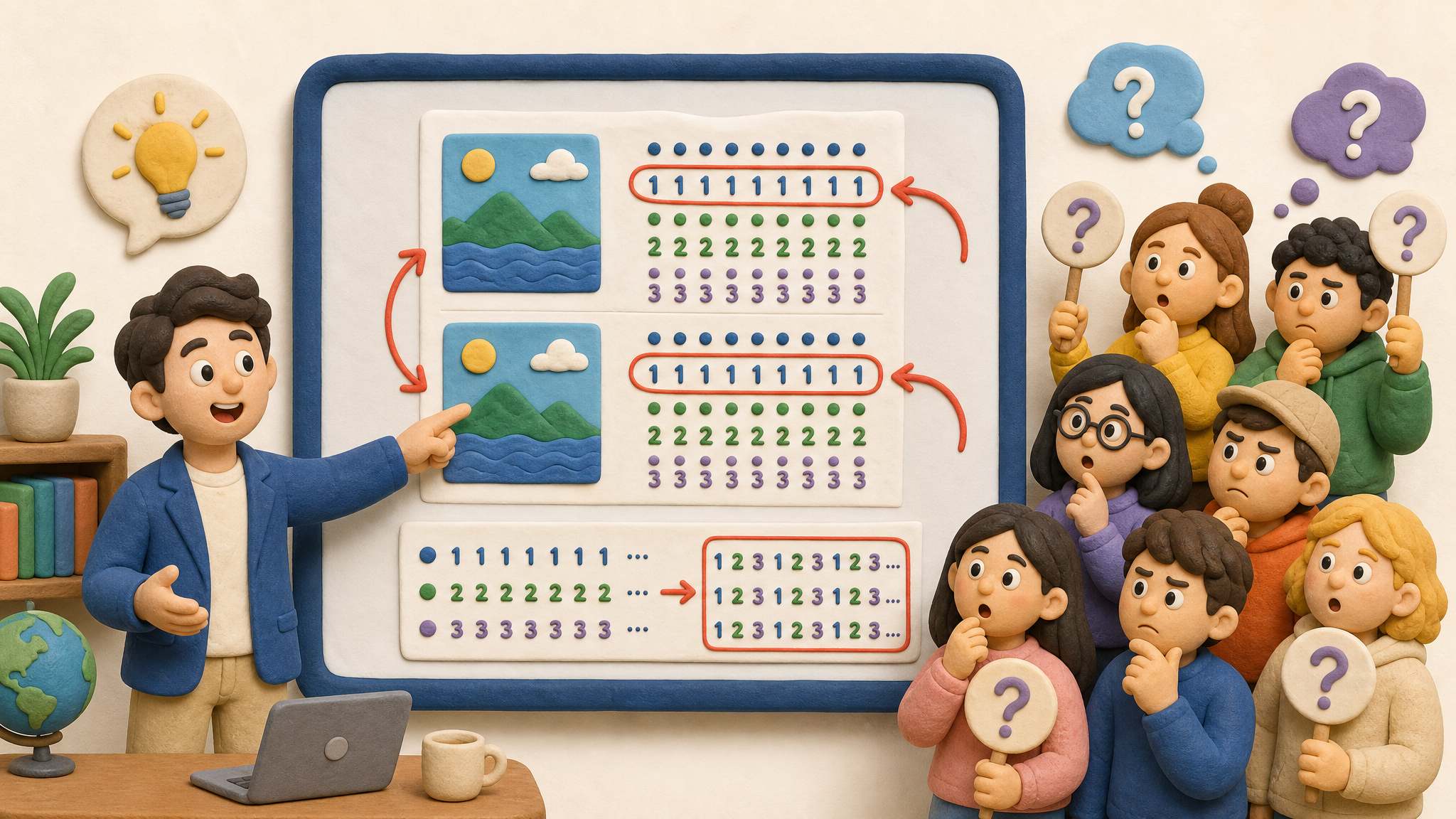

而且这个人在开始质疑学术造假之前就是大 V,他自己的表达能力非常强,可以很好地调动观众的情绪,观众们也愿意跟着他的情绪走。他把普通人完全看不懂的科研问题,变成了几乎人人都能围观的视觉证据。

过去如果有人说,这篇论文的数据可能有问题,大多数观众会说,你们专家之间吵呗,我也听不明白。因为生物、细胞这些东西,普通人根本听不懂。

但耿同学的玩法不一样。他在论文里找什么呢?数字不对。比如后边都是 0.5、0.5、0.5,或者 0.25、0.35、0.45。我看过一期他的节目,他说这个人是不是一个热爱 5 这个数字宗教的忠实信徒。他会用这样的方式来讲这个事情。

而且他在论文的补充材料里,也会去挑一些毛病。还有实验图,说你这个图是不是不太合理。这个普通人根本看不懂,但是普通人能看懂的是图片重复:这个图在哪篇论文里还出现过,你用了别人的哪张图,然后把人家一模一样地抄过来了。

那论文里头不能有重复的图吗?这个还真不行。因为论文真正重要的是整个实验的过程数据,以及实验相关的图表。如果图是用别人的,那你怎么能够证明自己的观点呢?这事肯定是有问题的。

还有一些看起来过于整齐的数据规律,也会被他拎出来。比如某一列的数据跟后边隔几列以后的一列数据,可能是一个很简单的等差关系,比如都是加了几,都一模一样的。这一看就是作假做得不认真。

耿同学经常讲一句话:美国人也作假,哈佛什么的都作假,但是人家作假做得很认真,你这个一点都不认真。他最后把这事讲成这样了。

观众通常是不懂生物医学的,但是会受到巨大的视觉冲击:原来顶刊论文也可能藏着这么直观的问题,这个世界是个草台班子,你们也太敷衍了吧,搞成这样。

所以这期视频,我们不只是讲耿同学是不是英雄的问题,这个问题太小了。真正要讲的是:耿同学到底是谁,耿同学的账号是怎么发展起来的,他最近打了哪些案例,这些案例现在有什么结果了,他怎么变现,商业化有没有风险。

这里头没有雷锋,我是不相信有人说“我就热爱,我就干这个事了”,一定是要有变现的。那么科研打假到底是正义,还是流量猎巫,这个是今天要讲的东西。

最后,我们可能还要回过头去看一下中文互联网圈里绕不开的人:方舟子。一说中文打假,大家肯定会想到方舟子。方舟子到现在也是一个毁誉参半的人,你不能说他完全翻车了,也不能说他就像一个圣人。我们也看一看,方舟子的案例能够给耿同学一些什么样的启示。科研肯定需要打假,但是打假本身也需要有规矩,也需要有监督。

首先,耿同学是谁呢?这不是一个素人,也不是体制内的审判官,他是介于中间的一个位置。你说真的是素人,说我们从来没学生物医药,从来也没有做过科研,让你去看那个东西,你也看不出毛病来,所以一定不是。

这个人叫耿宏伟。根据目前公开的资料和账号的自我介绍,他是吉林大学生物学本科、吉林大学生物学硕士、北京航空航天大学生物与医学工程方向的博士。但是他最后好像博士没有毕业,据说是到博五还是博几,然后肄业了。但是他具体怎么肄业的,为什么没有毕业,这个事他自己并没有介绍。

现在的基本猜测是两个:

但是这些都属于网友的猜测,一定要讲清楚:具体为什么不知道。

所以耿同学不是完全不懂科研的普通网红,也不是拥有正式调查权的高校或者监管机构。他更像是一个站在学术圈门口的半个圈内人。他懂得论文的语言,懂得实验的套路,也懂得社交媒体的传播。

现在他的方案就是:找脑袋大的来,杰出青年、长江学者、院长、发《自然》的。内容也从观点评论变成了具体的论文证据,结果从网友围观变成了学校启动调查,甚至公开处理。他不再只是讲科研圈的故事了,他变成了一个能够推动高校回应的舆论变量。

2026 年 5 月份,因为同济大学的事件出现了正式处理结果,耿同学的角色就发生了变化。因为以前打假的人也有,但是大家都不理你。这一次是真的有人因为他被撤职了,有人因为他被降级了,他就被重视起来了。

我可以重现你的结论,但是没有任何评审人会去给你做重复实验。文章公布以后,会有其他实验室去做重复实验。如果大家都重复不出来,这个时候就会质疑这篇文章,那么这个文章就有可能会被撤稿。要么你就告诉大家你怎么做出来的,要么咱们就把它删了。

去年大家还记得那个叫 LK-99 的,就是韩国人做的那种高温超导。他自己号称做出来了,但是全世界所有的实验室都做不出来,没法重复。所以 Nature 把你的文章放上去,只能说明你的同行评议过了,评审认为你基本上格式是完整的。它那个数据也不会给你去做评审的,也不会给你做重复实验,而且做评审的人是匿名的。

耿同学的玩法也差不太多。他也没有办法去给你做重复实验,因为他也没有实验室。他要看统计方法、数据之间、图表之间是否相互矛盾。

所以他的打法概括成一句话:不进实验室,但是拆公开材料;不做最终裁决,但是逼着论文作者和学校给解释。我觉得你这个这么多 5、这么多 0.5、这么多 0.05,这是为什么呢?你给我个解释。

这个方法有价值。价值是什么呢?门槛比较低,传播比较快,因为大家都能看得懂:这太糊弄事了。证据很直观,普通人也能理解。

但是它的局限也很明显:

因为他提出这样的质疑以后,可能学校还没有给出调查结果,很多人就说你一定是错的,你一定有问题。这个相当于是一个网暴的过程,非常非常危险。

所以耿同学可以提出强烈的质疑,但是最终认定必须要依赖学校、期刊、调查组和原始数据。

最近他打了哪些成功的案例呢?现在同济大学已经有结果了,其他仍在调查之中。

同济大学涉事的第一个人叫王平,同济大学生命科学与技术学院相关负责人,公开报道中称其为院长、国家杰出青年、长江学者。他是论文的通讯作者,也就是导师。第一作者叫金佳丽。涉事论文发表在 Nature 上,顶刊。

耿同学的质疑是:论文数据规律异常,部分数据、图片存在可疑之处,公开材料显示出的数据形态不像正常的实验结果。

结果是什么呢?2026 年 5 月 6 日,同济大学通报调查结果,王平被免去学院院长职务,专业技术岗位等级被降低,一定期限内取消岗位聘用、工资降级、职务晋升、科研项目申报、评奖评优等资格,通通都取消了。第一作者金佳丽被解除聘用关系,这直接开除了。

学校将问题定性为论文存在学术不端、记录不规范、数据真实性和可重复性方面存在责任问题。数据真实性和可重复性方面存在责任问题。

这就是耿同学爆火的真正转折点:这真的有人理你了,而且真的有人被降级,有人被开除了。这个基本上算顶格处理了。因为前面被降级的王平,这两年不能申请新的项目。这两年过了以后,你要再去申请项目的时候,人家是要求你这几年有项目成果、有科研的。你都没有的话,这辈子可能都很难再去申请到新项目了。

同济通报之后,大家发现,原来这个博主不是只会骂,他是真的推动高校去处理这个事了。

南开大学有一个陈佺事件,学校已经开始调查了,结果还没出来。这个陈佺是南开大学生命科学学院相关负责人,涉事论文发表在 Nature Cancer 这个杂志上。

上海交通大学医学院附属新华医院相关机构,涉事论文发表在 Nature Nanotechnology 这个子刊上。耿同学质疑数据模式异常,部分数字规律不自然,被质疑存在人为编造的痕迹。

结果是,2026 年 5 月 12 日前后,上海交通大学也发布了情况通报,表示第一时间成立了调查组,启动了调查程序,但是结果也还没有出来。

为什么他会爆火呢?不是因为大家就突然懂科研了,这个是不可能的,绝大部分人都不会看懂这玩意。而是因为大家不太相信系统。只要有人说他们作假了,我们更愿意相信一点。人其实是有一点点被迫害妄想症的。

耿同学爆火,表面上是论文打假,实质上是公众对于科研系统的信任缺口爆发了。

前两天还有一个笑话:你是怎么挣钱的呢?

前面中国政府是把很多食品打假的人给处理掉了,因为这些人被认定为恶意打假。就是你打假的目的并不是为了让假货变少,而是为了敲诈勒索。你明知道这个东西是假的,你还知假购假,把它买回来以后去索赔,这个事是政府不允许的。

耿同学到目前为止,应该没有干过直播带货,好像也没有怎么给人做过广告。他在 Bilibili 有 100 多万关注,抖音也有 100 多万关注。只是靠内容的广告分成的话,应该养不活他,因为国内这一块的收益是很低很低的。

他的 B 站上是有商业变现链接的。你如果想跟他谈一些事情,是可以跟他谈的。但是具体怎么变现,因为打假账号跟普通的科普账号是不一样的。

科普账号可以接广告,观众最多担心你是不是恰饭了,你拿人钱,你就说这个好,或者你说一些丧良心的话。

但是打假的是没法轻易接广告的。大家会想:

所以科研打假人必须要讲清楚他怎么商业化。最理想的披露方式,就是像国外这些打假人一样,建立一个公开透明的披露机制,披露收入来源。科研打假本身就是科学共同体自我修复的一部分。

耿同学这个事情肯定有一些负面的东西。打假最怕的是从证据链滑向情绪链,因为我们讲,打人没好手,骂人没好口。

耿同学自己也是一个很擅长制造流量、很能说的人。可能很多其他能够打假的人,自己并没有这种表达能力。他把一堆数据列在那,把这些有问题的东西放在那以后,他说不清楚,或者没有办法用普通人能够理解的方式把它说清楚,他这个内容就没人看,没有传播力。

但是耿同学是很有传播力的。他的嘴上也确实有点得理不饶人。很多打假都有可能会变成人身攻击或者人格攻击,这就反而让整个打假过程、让证据链不那么站得住脚了。

他曾经有一次,我忘了是质疑了谁的长相,说你长得就不好看,最后也没办法,出来道歉,说对不起,以后咱就说数据,至于你长成什么样,跟你做的东西是不是假的没关系。还专门有这样的一个道歉视频流传出来。

所以打假的过程,特别是想要在社交媒体上进行这种娱乐式打假的过程,很容易语言就出圈。一开始是质疑论文,然后就变成了羞辱作者,再后面可能就开始攻击学生、家属、同事、学校了。说你们这个学校怎么就这样了,你看不愧是谁谁谁的学生,就会夹枪带棒。这就从监督变成了网暴。

科研打假应该是数据、图片、论文、原始记录、责任链条、学校调查机制,应该用这样的方式去推进,而不应该羞辱长相、攻击人格、扩散隐私、动员粉丝围攻。他有时候也会讲这个话,说谁谁谁要去开研讨会的时候,任何粉丝你可以到那去,帮我去提这个问题。这个其实稍微有一些模糊地带。

因为一旦进入人格攻击,打假人就会丢掉最重要的东西,也就是公信力。但是民众喜欢。为什么我说这个东西像猎巫呢?猎巫的过程中,大量普通民众其实并不了解具体怎么回事,就是跟着去凑个热闹。

科技问题的社会娱乐化,会造成网暴的风险。绝大多数普通人其实并不能判断复杂的科学争议,他们只能相信自己喜欢的大博主。这就容易变成:

这就是科技打假全民娱乐化的一个巨大风险,它需要监管。

最后再讲一下方舟子。方舟子的事情并不是这一期核心的重点,但是讲到打假,方舟子又绕不过去。

必须承认,方舟子早年推动了中文互联网科学打假。他让很多人第一次意识到,有假论文、假文凭、伪科学、保健品骗局、名人学术造假。这些东西原来大家是不质疑的,方舟子以后,大家发现这些事情都是可以公开质疑的。所以他还是起到了一些正面作用的。

但是他也引起了很多争议。

罗永浩还有很多人去攻击他,就是说我们向安保基金里捐钱了,你得说清楚这钱到底是去哪了,到底怎么被花掉了。你不能说一个非营利组织,这个钱进去了以后,你就把它当自己的钱自己随便花,这事是不行的。

而且他坚决不承认错误。任何人敢批判他,他都是坚决不承认的。谁批判他,他就对人进行人身攻击。这就会造成公众形象越来越割裂:支持者认为他犀利,反对者认为他霸凌。

所以方舟子的现象给耿同学提个醒:打假人最大的敌人,不一定是被打的对象,也可能是自己的道德优越感、语言暴力和不透明的商业模式。

如果耿同学未来想长期做下去,他应该尽量避免的不是被骂,而是变成一个不可质疑的打假之神。因为神一旦建立起来了,纠错就变得非常非常难了。

最后,结论是:科研需要打假,但是打假也需要监管。所以回到标题上,耿同学爆火,科研打假是正义还是流量猎巫呢?我的答案是,它可以是正义,但如果没有边界,就会变成流量猎巫。

耿同学的价值在于:

但是风险在于:

2026-05-14 09:03:57

宇树 GD01 390 万的机甲梦,昨天刷屏了。这到底是高达成真,还是 IPO 之前的超级广告?

今天聊一聊宇树的“高达”:先梳理事实,再看产品定义、横向比较、战略意图以及前景展望。

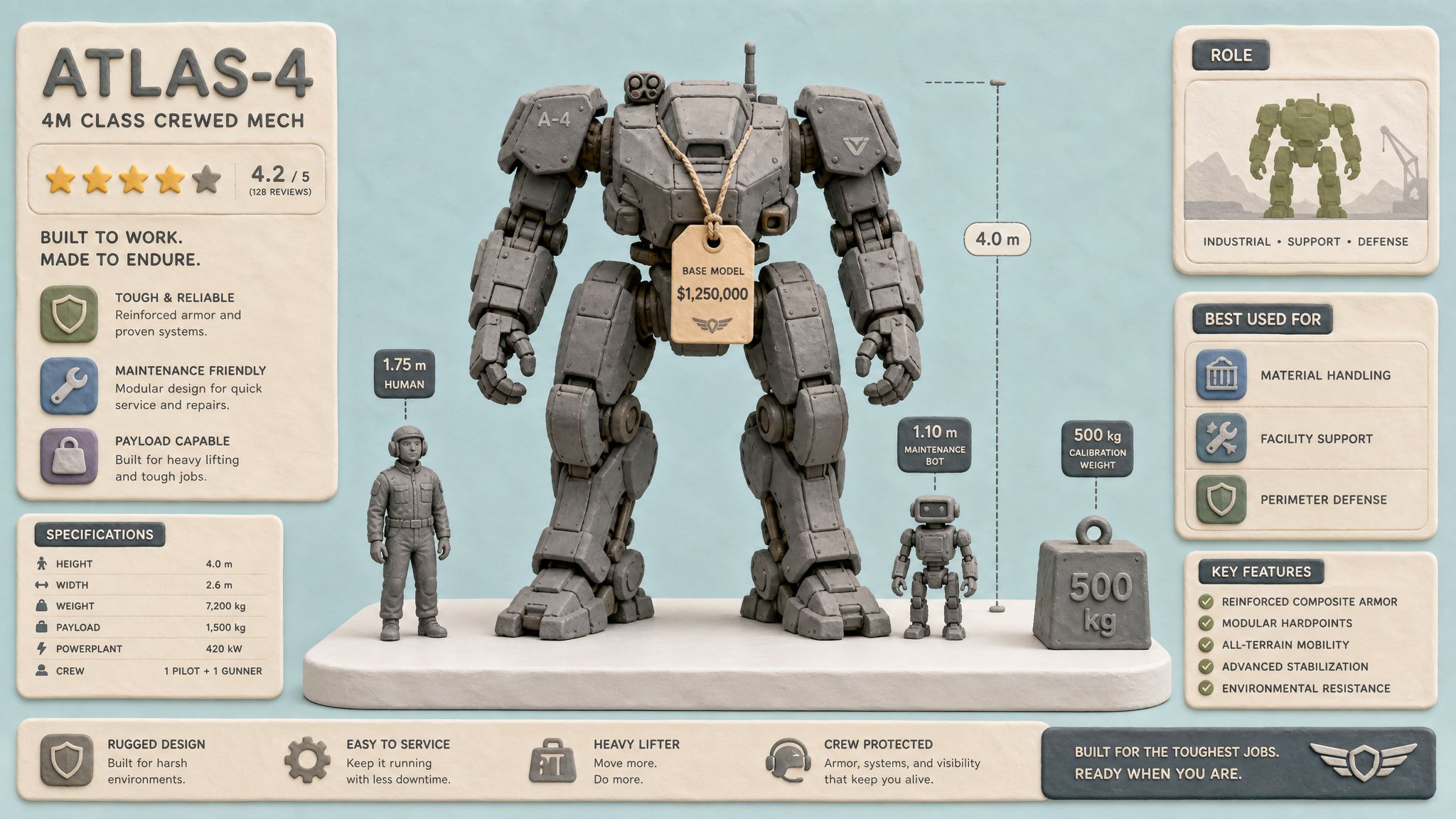

5 月 12 号,宇树突然放出一支视频,并做了一系列官宣。核心信息是:这台机器售价 390 万人民币,约合 65 万美元;已确认的参数之一是重量大约 500 公斤。从照片看,内部应该可以塞进一个人,也就是说这个架子里能够坐人。

其他信息并不完全确定。宇树反复强调的是:这是量产的、可销售的、有价格的;可以载人、可以变形,而且是民用载具,理论上可以在路上当交通工具使用。那么,宇树到底想干什么?这是一个很有趣的问题。

从公开照片来看,这台设备应该有 3 米多高,甚至可能有 4 米多高。它看起来比一个人的两倍还要高一些,但官方并没有公布高度。

其中一张照片里,宇树的王兴兴站在旁边,旁边还有 G1 和另一台更小的宇树机器人。王兴兴大概 1 米 72,这个身高曾经被人从某征婚网站泄露数据中推测出来,不过王兴兴本人最后既没有承认,也没有否认。至于他现在到底已婚还是未婚,也不是特别确定。这里我们暂且按 1 米 72 来估算。以这个比例看,GD01 可能有 4 米多高。

需要注意的是,这台机器人没有真正意义上的手。虽然看起来像有手,但那个“手”是固定形状,没有任何关节,基本可以把它当成一个圆形的角,只是中间握拳的位置有一个空心。

视频里,王兴兴爬上了这台机器人。可以看到,机器人的腿部有一些划痕和磕碰痕迹,胳膊肘上也有类似痕迹。它没有任何攀登辅具,比如梯子。正常情况下,应该是让机器人蹲下、趴下或者躺下,让人进入座舱;但视频里是老板自己爬上去,这本身也很有意思。王兴兴比较瘦,最后还是爬上去了。

这个攀爬过程看起来有些奇怪。如果这是一台双腿站立的机器人,一个 1 米 72、约 70 多公斤的人用这么大的力量往上爬,机器人理论上应该晃动,但画面里它几乎纹丝不动。因此推测,攀爬过程可能经过了一定剪辑,某个镜头时底下也许已经有固定支架。总之,视频呈现的结果是人确实爬上去了。

座舱边框上包着的东西像是自行车轮胎,应该是临时防震设备。内部确实有一个带五点安全带的座椅。继续往上爬时,可以看到整个座舱比较局促,脚最后能放进去,但过程应该并不轻松。

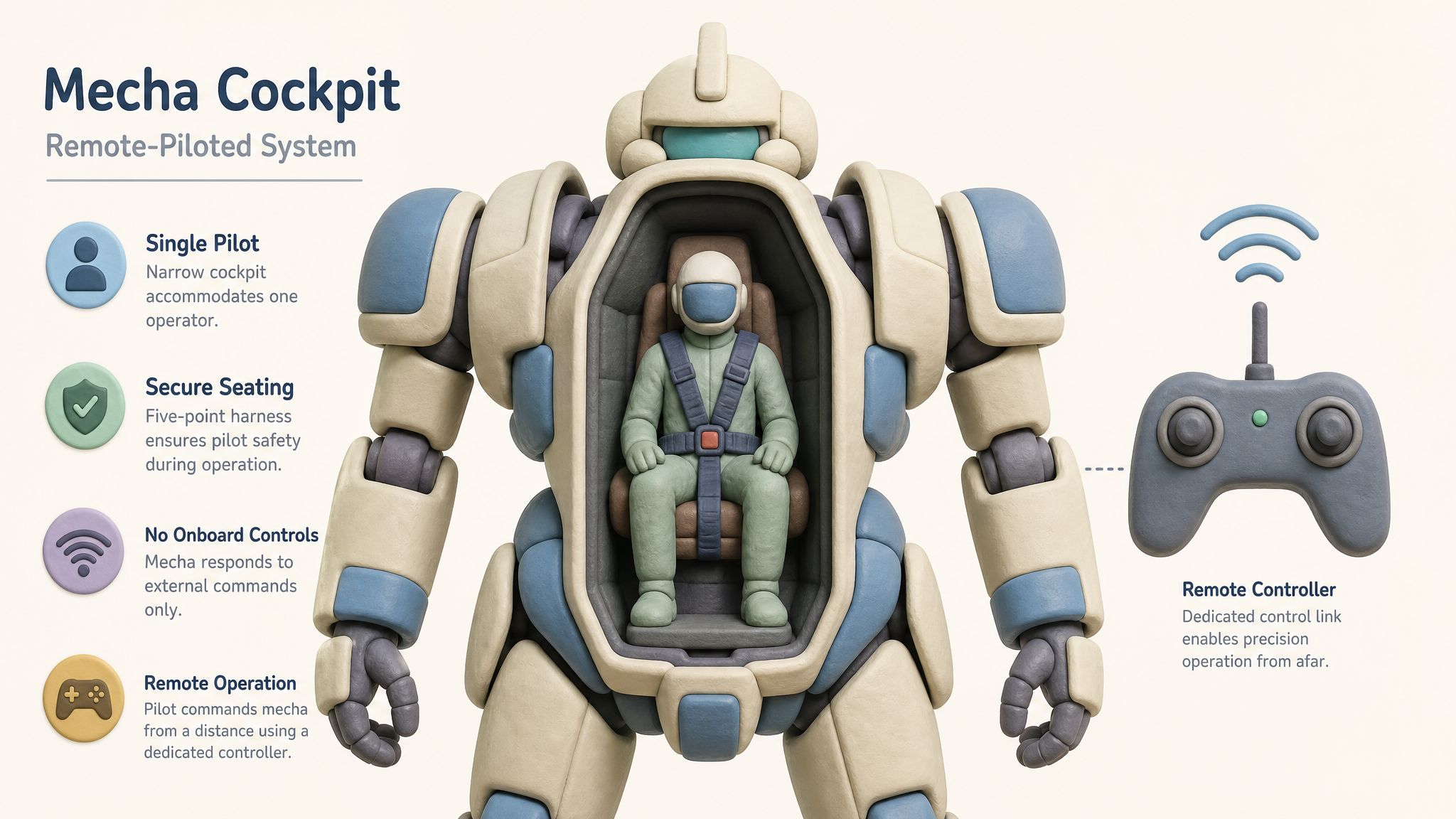

更关键的是,座舱里没有看到任何操控设备:没有显示器,也没有封闭座舱,更没有操纵手柄或按钮。从公开照片角度看,这台设备大概率是在外部遥控,里面只是坐了一个人,并用五点安全带固定住;坐进去的人似乎无法操纵任何东西。

从左侧机器人的胳膊可以看到很多划痕。这台机器人应该是真实存在的,并不是一个完全由 AI 生成的视频。机器上捆绑的自行车轮胎显得有些简陋,内部可以看到线缆,并用胶皮管封装。如此大的肢体上应该有一些电机。至于电池,推测可能位于座椅下方和后方,500 公斤重量里应该包括电池。

后续视频中,机器人动了起来,里面似乎有一个人,或者说一个人形物体,戴着头盔。到底是不是王兴兴,还是假人,目前不太确定。更希望那是一个假人,因为这样一台尚未看到任何安全认证信息的设备,不管是不是王兴兴本人坐在里面,都很难说安全。

视频里还能看到它站起来走的形态,也展示了用胳膊敲倒一面类似隔热砖墙的动作。做这些简单攻击动作时,座舱里已经没有人。看到这个敲砖动作后,也能理解它胳膊、腿上的划痕和磕碰痕迹从何而来。

比较“鬼畜”的一个状态是,机器人四肢着地,但方式很奇怪:它不是像正常生物那样趴下来,而是仰着躺下来。两个脚朝前,两个像球形关节的“手”直接落地。

这种状态下,人其实没法在里面正常待着。因为按照椅子位置,人会变成躺在里面,头朝前、脸朝上,脚在后面且需要支起来。在这个姿态里,人基本没有任何观察角度,因此这个状态已经不适合让人留在座舱里。

后面还有一段四肢着地行走的视频。布景看起来像临时搭建的,那辆车像是一台老式桑塔纳轿车,但画面总让人觉得有些违和,不太像真实环境。总之,它确实以四肢着地的方式往前走了一点。作为世界上做机器狗最多的公司之一,宇树显然也要展示一下自己的老本行。

不过不管是站立行走,还是四肢着地行走,上方座舱晃动都很明显。它不像轮式机器人那样运动起来相对平稳。两条腿或四条腿往前走,本身就会比较晃。

这就像人身上挂一个摄像头走路,录出来的视频也容易让人头晕。有人为了拍稳定视频,会用所谓“大疆步法”:屈膝、小步往前挪,才能尽量稳定。但人坐在这台机器人里到底会有多晕,目前并不知道,因为对应状态下座舱里并没有人。

从王兴兴再次攀爬的角度看,这台机器人的腿和手臂长度应该不够 1 米 72,但加上上方座舱后会比 1 米 72 高很多。因此推测,它四肢着地时可能有 2 米多高,站起来时大约 4 米多高。

现在传统人形机器人领域竞争非常激烈,甚至已经可以称为“传统”赛道。不管是美国的特斯拉擎天柱、Figure 03,还是国内的宇树科技、智元科技,大家都在做这一块。

从运动性能来说,国产机器人其实比美国机器人更强一些。原因有两个:第一,国内确实做得便宜;第二,国内做了大量测试。所谓“小脑”部分,也就是整体运动机能、平衡、翻跟头、跑步等能力,中国这套方案应该比美国更强,因为确实在这一块下了很多功夫。

但“大脑”部分,比如机器人协作、机器人执行任务、进工厂干活、分拣包裹、做家务等,美国这边更强。今年多个公司都要量产,包括宇树、智元、特斯拉擎天柱和 Figure 03。

前两天 Figure 03 还发布了一段视频,展示两个机器人在没有进行任何训练的情况下,可以相互配合,跑到家里叠被子、收拾床铺。这是非常强的能力。同时,行业也在卷灵巧手等方向。

宇树在这个赛道的优势是:现在卖得多,而且“小脑”非常发达。但其他优势很难追上头部对手。

另一块相关方向是外骨骼。现在外骨骼在国内已经很普遍,刷抖音经常能看到各种外骨骼广告,比如老年人穿上外骨骼去爬山、上楼。军队也开始使用外骨骼进行登山或野外搬运。

这块已经比较普及,但并不是宇树最强的领域。

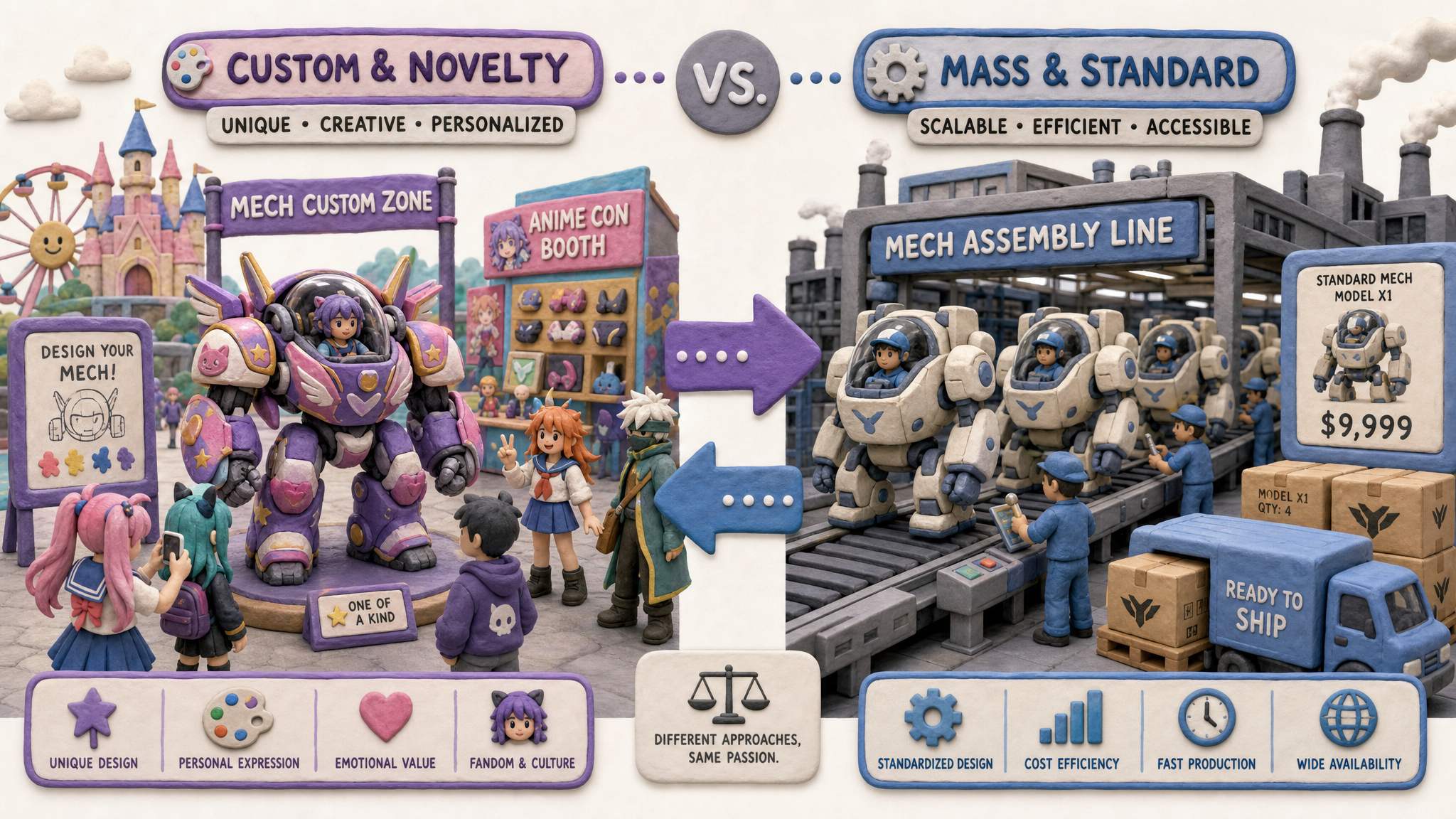

宇树这次要做的,是一个叫“载人机甲”的东西。它相当于要抢一个新的品类定义权:这个东西是我发明的,不管最后是谁做出来,但最先定义这个品类的是我。

它的核心是:人坐进机器里。至于操控到底是不是在内部完成,现在看不出来。未来可能会在内部操控,但至少目前公开画面里,没有看到任何操纵设备。

目标是成为人的延伸和放大,实现某种“人机合一”的操控和力量倍增。宇树的强项是做“小脑”。既然“大脑”不够强,那就把一个人塞进去。如果人可以在内部操作,这类设备确实有想象空间。

宇树并不是第一个做机甲的公司。现在已经有一些有趣的机甲形态。

宇树现在强调的差异化是:那些设备是定制的,而它要做的是量产。有标价,390 万;有重量,500 公斤;理论上大家都可以买。

现在大家都在争抢机器人行业领军企业的位置。在美国市场,宇树很难抢过特斯拉或 Figure 03。虽然宇树的小脑很发达,机器人可以跳舞、翻跟头,但特斯拉并不是做不出来,只是可能认为这类训练现在意义不大。至少在翻跟头这件事上,宇树应该是做得最好的。

在国内,宇树也面临智元等一大批公司的竞争。此前北京马拉松机器人相关活动里,荣耀科技跑了一二三名,宇树没有露出来。宇树又正处于准备上市的时间点,因此非常需要一次品牌破圈。

对宇树来说,做这种大型人形机器人并进行外部遥控,是它能做到的事情。大家经常看到的 99,000 元宇树 G1,本质上也是一台遥控机器人,外面有一个巨大的遥控器。

但有遥控器并不等于简单“遥控机器人跑”。这就像无人机,虽然人手里有遥控器,但无人机本身有飞控系统,可以保持稳定、抗风,并完成很多基础动作。

机器人也是如此。它需要能稳定平衡。当你命令它前进、后退、跳一下时,机器人要在“小脑”里确认:怎么迈腿、怎么前进、怎么保持平衡,跳起来落地后怎么别摔倒。

既然宇树已经能搞定这些事情,那么它只要把机器人放大,再把人放进去就行。现在也许仍是外部遥控,未来或许可以把遥控界面放进座舱里,让人坐在里面、系好五点安全带,抱着遥控器,或者把遥控器直接装在座舱里。

这相当于向外界展示:我的“小脑”行;如果“大脑”不行,那我就把人的大脑塞进机器里。这个视频也获得了非常好的全球传播,在 Twitter 和 YouTube 上都有很大的播放量。

它的手目前没有办法拿东西,本质上是一个固定外壳的“死手”,所以有效载荷目前也没有那么关键。

虽然宇树说这是量产、民用、可销售的产品,而且很多媒体,包括《连线》杂志,都在追问这到底是真的还是 AI 视频,但宇树非常坚持地表示:这是一个成熟产品,是量产的,而且有价格,随时可以买。

不过,花了钱什么时候能交货,目前并不确定。最终量产版交付周期并没有说明。

一旦把人装进去,就必须保证基本安全。它不像 99,000 元的宇树 G1,买回去可以当成大玩具。GD01 是 500 公斤级别的大型运输机械,而且可以在地上走。一旦载人,它就不再是玩具,而是一个非常严肃的安全与合规挑战。

如果它砸到别人,或者把座舱里的人伤到,都会是严重问题。因此后面还有很长的路要走。

中国政府本身对载人载具有一些安全认证标准,但 GD01 到底应该归入哪个方向、拿了哪些认证,目前都不知道。安全监管一定会是很大的问题。

不过,作为第一家定义这种产品的公司,即便宇树现在可能还没有拿到相关认证,未来中国政府乃至全球政府制定相关规则时,宇树都有机会坐到桌前参与讨论。不太可能是政府把规则定完之后再通知宇树;更可能是让宇树参与讨论,这类设备到底应该如何定义、如何认证。

因此,第一个拿出这种设备的人,在订立标准时就有了上桌资格,这非常重要。

390 万人民币、65 万美元的机甲,首批客户大概率不是普通消费者,而是看中它超级营销道具价值的人。

至于有没有富豪愿意买回去当玩具,这件事还真不好说。几千万的跑车在中国都能秒光。如果这个东西相对安全、可控,确实可能有富豪买回去,坐在里面满街溜达。

但让这个东西真的满街溜达,还是有些危险。

至于爬山、山地救援等用途,现在谈还太早。未来这种内部坐人的设备,是否可以用于搬运、航空航海或山地救援,确实有可能。它相当于一个巨大型外骨骼,这部分仍然有想象空间。

宇树发布的 GD01,并不是“高达成真”了,而是一次品类抢位。

它想告诉大家:这是量产的、可以直接销售的、里面可以坐人的机甲。

这就是宇树这次在做的事情。

2026-05-13 08:50:46

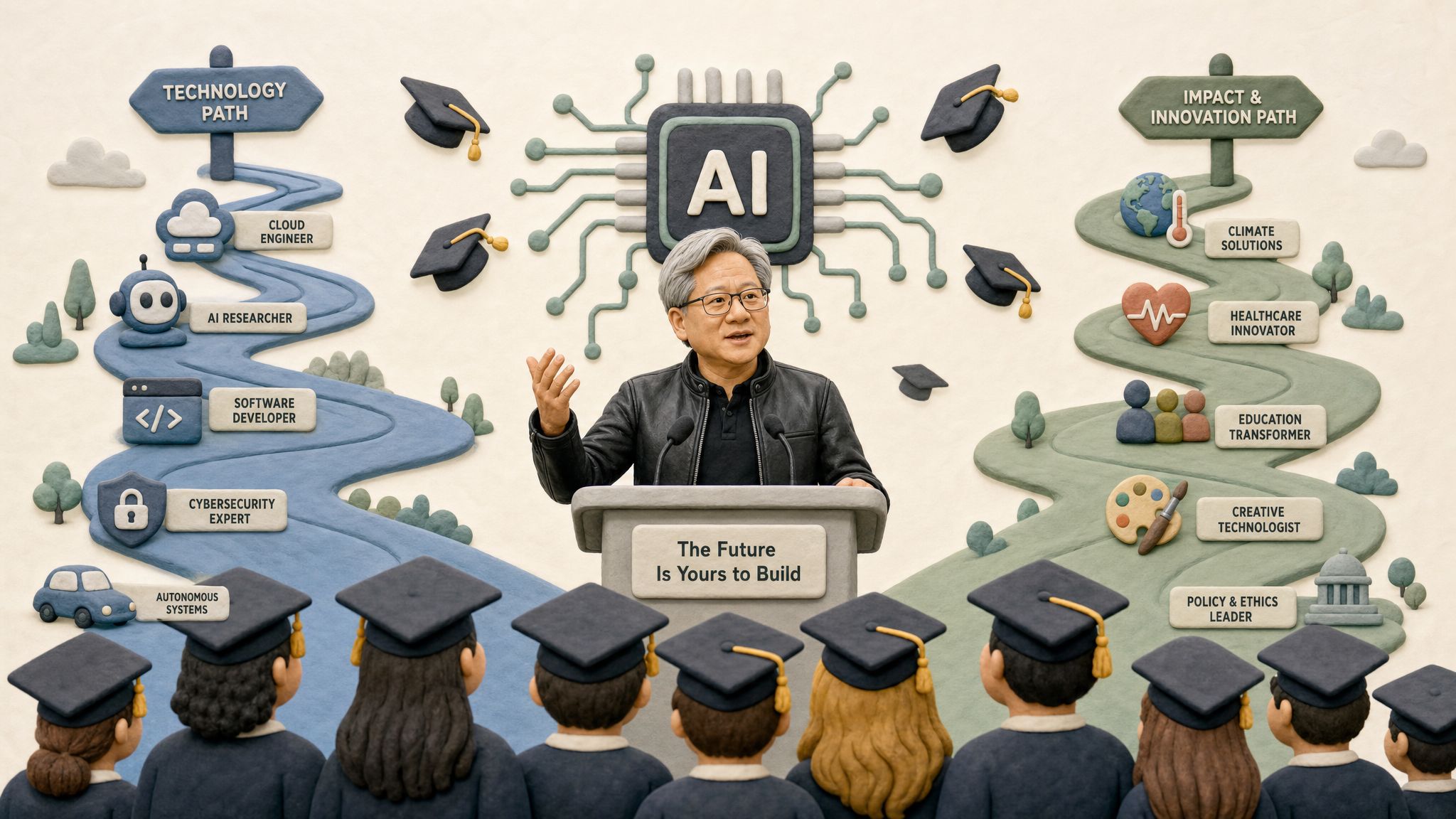

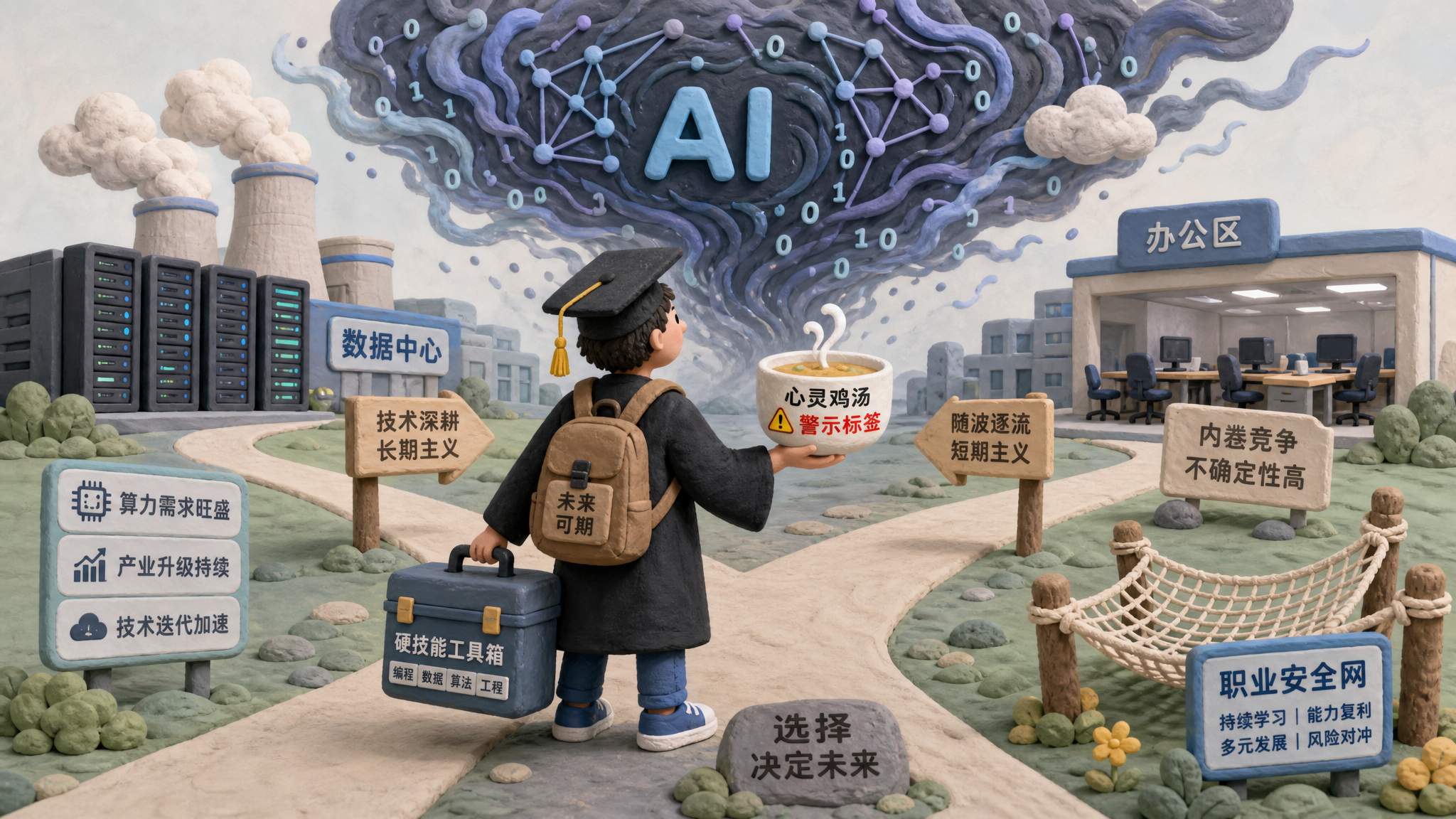

今天聊一场特别的毕业演讲。黄仁勋去了卡耐基梅隆大学,站在 2026 届毕业生面前,告诉这些年轻人不要害怕 AI,你们赶上了一个最好的时代。

这句话听起来非常热血,但是放在今天这个就业环境里,就有那么一点刺耳了。Anthropic 的 CEO 阿莫迪就在讲,AI 可能会消灭大量入门白领岗位。实际上,这就是卡耐基梅隆大学毕业生要去争取的那些岗位:入门白领岗位可能就没有了,而且要消灭多少?一半,50% 就没了。

另外一边,马斯克讲的是什么呢?他讲的是,AI 有 20% 的可能性会让人类毁灭,剩下 80% 的可能性会带我们奔向繁荣富强。

当然,这还不是最夸张的。谷歌 X 前高管莫高达特说得更吓人,他说我们从 2027 年开始,会迎来 12 到 15 年的地狱,12 到 15 年以后是天堂,但是中间这 12 到 15 年是地狱。

结果黄仁勋就站出来了,说你们这帮 CEO 不要总是摆出上帝视角,应该回到现实,应该乐观,应该建设。

所以这期节目的真正意义,不是黄仁勋又拿到了一个荣誉博士,也不是他又上来讲“AI 不会取代你,AI 会再带来更多就业”。真正有意义的是,当 AI 已经开始改变就业、产业、教育和人生路径的时候,最成功的幸存者,正在教育还没有上牌桌的年轻人:不要怕,冲啊。

为什么说黄仁勋在放毒鸡汤?幸存者说的话一定就是对的吗?不一定。但是幸存者说的话一定是不完整的,他肯定掩盖了一些东西。今天我们就顺着这场演讲,拆一拆黄仁勋这碗毒鸡汤:为什么有效,为什么危险,又为什么哪怕有毒,我们可能还是要去喝。

首先确认一个基本事实。2026 年 5 月 10 日,卡耐基梅隆大学举办了第 128 届毕业典礼。黄仁勋作为英伟达创始人兼 CEO,在现场发表了主题演讲,并被授予科学与技术荣誉博士学位。卡耐基梅隆大学官方新闻说,这场毕业典礼授予了 5,800 多名本科和研究生学位。

这个场景本身就很有象征意义。卡耐基梅隆大学是美国计算机科学、机器人、人工智能的研究重镇,大量技术从这里来。黄仁勋是这一轮 AI 浪潮中最核心的商业人物,一个做 GPU 算力中心、一个卖铲子的人,站在一所以 AI 和机器人闻名的大学里,对即将毕业的年轻人讲未来。这个画面本来就非常有传播力。

这里还有一个细节也很有意思。上去给他发荣誉博士披肩的人是谁呢?是英特尔的 CEO 陈立武。这很有意思,现在美国做芯片的这帮老大,英伟达的、英特尔的、AMD 的以及博通的,全都是华人。而且这帮人在这一次川大爷的访华行程里都没有抢到票。本来黄仁勋应该有一个登机牌,但是在最后一天,黄仁勋的登机牌被马斯克替代了。

大家想想,万一这四个人,黄仁勋、苏姿丰、陈立武,再加上博通的这位华人老大,跟着川普到中国来了,那直接在咱们这都讲中文就完了。川普说,你们都在说啥?这也是一个很有意思的事情。最后甭管是英特尔的陈立武,还是苏妈,还是黄仁勋,都没有抢到登机牌。

大家要注意一点,黄仁勋自己并不是 CMU 毕业的,也就是说他不是卡耐基梅隆的。黄仁勋的本科是俄勒冈州立大学,硕士毕业于斯坦福大学。陈立武也不是这里的,他本科是南洋大学,后来是 MIT 硕士、旧金山大学 MBA。所以你只要成功了,这边去发学历的人和最后得学历的人是不是这个大学毕业的,就都没有那么大关系了。

所以这场典礼不是校友衣锦还乡,而是一所顶级大学请来了当下最有时代符号意义的科技公司 CEO,给毕业生提供一套关于未来的叙事。这套叙事的核心非常简单:AI 不是终点,而是起点;你们不是被 AI 淘汰的一代,而是和所有人一起重新站在了起跑线上。

黄仁勋也讲,你们再也不用去顾及以前那些老人的经验了,因为站在 AI 面前,大家都没经验。这也是黄仁勋给毕业生的第一层安慰。

黄仁勋这次演讲大概分三个层次。第一层是他个人的奋斗史。

他讲到自己 9 岁来到美国,先住在肯塔基州一个煤矿小镇附近的寄宿学校里。后来父母来到美国,家庭条件并不好,母亲凌晨 4 点就会把他叫起来去送报纸。后来他哥哥给他找了一份在 Denny’s 快餐店洗碗的工作。黄仁勋说,当时他觉得从送报纸到洗碗,已经是一次重大的职业晋升了。

这段话非常有传播力,因为他不是说“我天生厉害,我天生要改变世界”,它更像是一个非常淳朴的移民故事。他讲自己是第一代移民,活下来,干活别挑剔,先把眼前的机会抓住。他讲的是这样一套东西。

然后黄仁勋讲到,30 岁的时候,他和合作伙伴一起创办了英伟达。他说当时他们完全不知道怎么创办公司,也不知道怎么融资、怎么经营,也不知道这个技术到底能不能实现。这能有多难呢?结果非常非常难。第一项技术就行不通,钱烧完了,最后他不得不飞到日本去向世嘉的 CEO 解释。

世嘉当时做游戏机,找他们做图像卡,最后没做出来。他要跟人解释:对不起,您让我们做的这个东西,我做不出来,失败了,但是你还得把钱给我。因为如果你不把钱付给我的话,我就完了。最后世嘉的 CEO 还是把钱付给他了,让英伟达继续存活下来。我们才有今天可以看到的全世界市值第一的公司。

黄仁勋讲,这应该是他这一辈子做的最痛苦的一件事情:拿了人家的钱没做出来,飞过去说对不起,但是你能把这钱付给我吗?

这个故事在黄仁勋的演讲中非常关键,因为他真正想传递的不是“我很惨”,而是你们今天面对 AI 的不确定性,我当年也面对过完全不知道怎么解决的不确定性。

第三层才是 AI 时代的机会论。

黄仁勋说,他的职业生涯开始于 PC 革命的开端,而 2026 年的毕业生,职业生涯开始于 AI 革命的开端。他认为,过去 60 年的计算模式是人写软件,计算机执行命令;现在这个模式正在结束。AI 把计算从人类编程推向了机器学习,从 CPU 上的软件推向了 GPU 上的神经网络,从执行指令推向了推理、理解、规划和使用工具。

不要害怕未来,要参与未来;不要慢慢走,要跑起来。

这句话很黄仁勋,也很硅谷。

在他看来,AI 会自动化很多任务,但是任务不是工作的全部。软件工程师会用 AI 解决更复杂的问题,医生会用 AI 做更多的诊断,电工、水管工、钢铁工人、建筑工人、技术员,也会因为 AI 基础设施建设获得机会。

AI 不一定取代你,但是更会用 AI 的人可能会取代你。

这也是为什么我说黄仁勋是在说毒鸡汤,而且是中国大家长式的毒鸡汤。他讲的话是什么?你不要输在起跑线上。大家有没有感觉稍微有一点熟悉了?

这套逻辑本身并不荒唐。我们所有人都是这么长大的,我们所有人也都是这么去教育自己孩子的。技术革命确实会消灭一些旧的任务,也会创造一些新任务。

但问题在于,被消灭的人和获得新机会的人,往往不是同一批人;被技术提高效率的岗位和被技术压低价格的岗位,也往往不是同一个岗位。

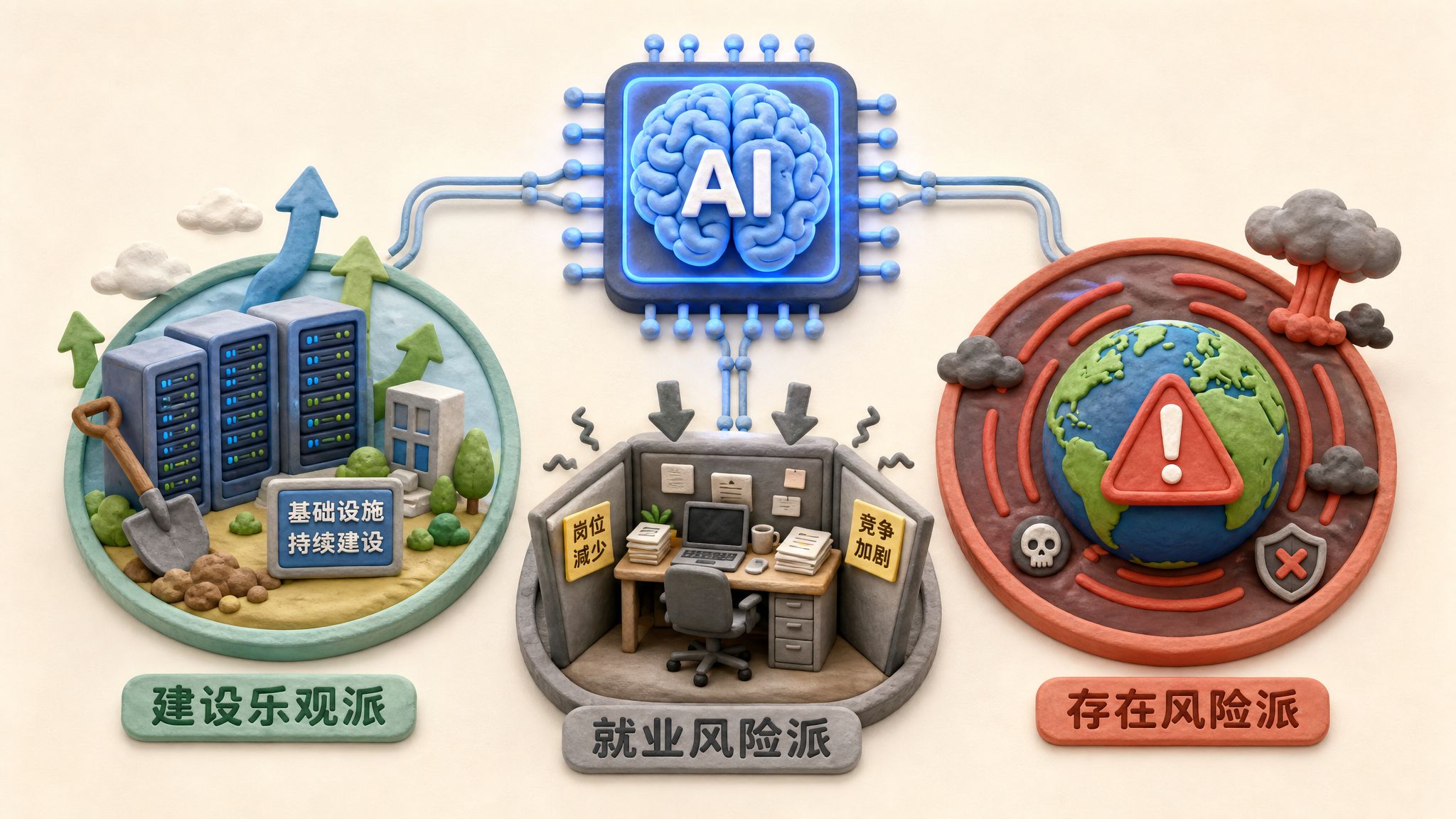

所以我们要进入下一层。黄仁勋的乐观,不是整个 AI 世界的乐观。同一场革命,有人看到了机会,有人看到了失业和毁灭。

现在关于 AI 的讨论,大概分为三派。

第一派就是黄仁勋的建设乐观派:我们先建设起来,我很乐观。他们认为 AI 会提高生产率,扩大能力边界,创造新的产业、新的岗位、新的基础设施。只要人类负责任地推进技术,整体收益会大于损失。

这套说法背后有非常现实的商业逻辑。英伟达就是卖铲子的,黄仁勋当然希望更多人相信 AI 是机会,相信企业应该买 GPU,相信国家应该建立计算中心,相信年轻人应该学会使用 AI。所以他并没有说谎,但是我们必须知道,他的立场天然站在建设更多 AI、卖更多英伟达算力卡的立场上。

第二派就是 Anthropic 的 CEO 阿莫迪,他属于就业风险派。

在 Axios 2025 年 5 月份对 Anthropic CEO 达里奥·阿莫迪的采访中,阿莫迪警告说,AI 可能在 1 到 5 年内消灭最多一半的白领岗位,并且可能把美国失业率推到 10% 到 20%。他是 2025 年讲的,而且他一般讲的时候都是说明年怎么怎么样,但是现在已经 2026 年了。

这个预测非常吓人,因为它打中的不是遥远的未来,而是大学毕业生最关心的第一份工作。过去一个年轻人进入咨询、金融、法律、媒体、软件、产品、运营,通常是从低端任务开始:写初稿、做表格、整理材料、查资料、跑流程、改 PPT。而这些任务恰恰是现在 AI 干得最顺手的这一批。

第三派就是马斯克这一派,存在风险派。

马斯克在参加罗根的节目里讲到,他认为 AI 有 20% 的可能性会毁灭人类,同时也说有 80% 的可能性会走向好的结果。这也非常马斯克,既像警告,又像冒险家在下注。这类观点关注的不是某个岗位,而是 AI 最终会不会变得比人类更强,脱离控制,甚至威胁人类整体生存。

黄仁勋为什么会痛批这些说法呢?因为在他看来,科技领袖们天天讲末日,会把社会推向恐惧;恐惧会阻止人们去学习、去建设和参与,也会阻止人们去买他的显卡。所以媒体报道说,他把一些 CEO 末日式的表达称为上帝视角,也就是高高在上,仿佛觉得自己知道所有人的未来一样。

但是这一点,黄仁勋说得并非没有道理。问题是,他在批评别人的时候,其实自己也是站在上帝视角上的,并没有那么大的差异。只是两种不同的上帝视角:一种是黑色的,大家要小心;一种是绿色的,赶快拿着美金上我这儿买显卡来。

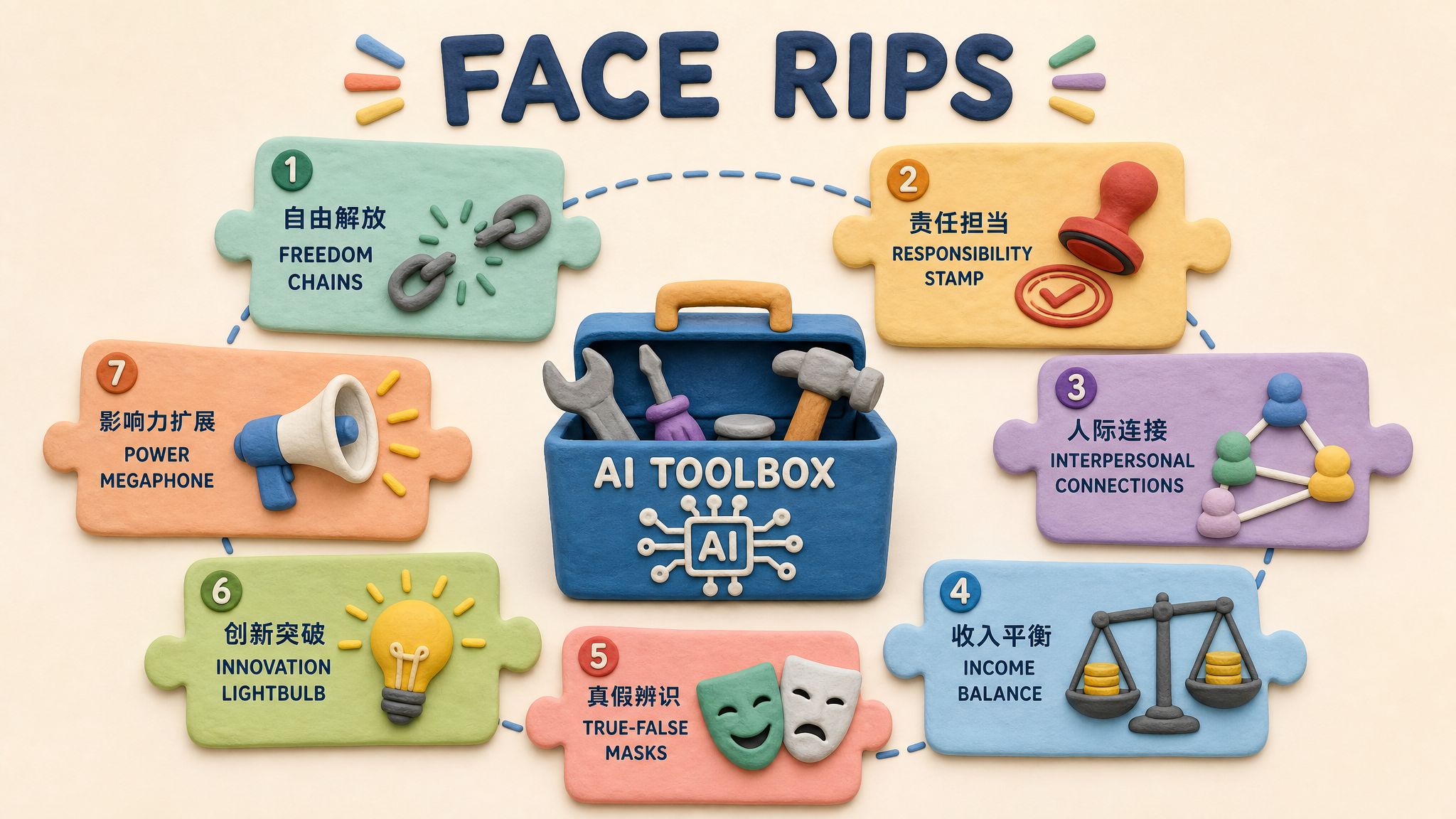

当然这还不是最惊悚的一派。最惊悚的一派叫莫高达特。他说的是什么?天堂之前可能有 12 到 15 年的地狱。

如果说阿莫迪讲的是岗位风险,马斯克讲的是存在风险,那么莫高达特讲的就是社会风险。

莫高达特是谁呢?他是谷歌 X 以前的 CBO,Chief Business Officer,也就是首席商业官。谷歌原来有一个部门叫 X 部门,各种新的业务都是从这里孵化出来的。在孵化过程中,CBO 会帮这些天马行空的科学家们把项目落地,思考怎么能够把项目卖掉。而这个 X 部门里孵化出来最有名的项目,就是谷歌的无人驾驶。

这个人离开谷歌以后,写了一本书叫 Scary Smart,中文翻译应该叫《可怕的智慧》。这本书的基本观点是,AI 会变得越来越聪明,关键不只是 AI 自己会怎么样,而是人类会怎么训练、使用和操纵它。他并不认为 AI 会作恶,而是认为 AI 落到一些坏人手里后,这些坏人的能力会被极大增强,就有可能给我们带来地狱。

2025 年 8 月,他在参加 The Diary of a CEO 这个访谈时讲到了这件事情,说未来 12 到 15 年可能是天堂之前的地狱。为什么这么讲?他自己有一套框架,叫 FACE RIPS。

莫高达特也给出了一些建议,不是躺平。没有任何科技大佬会要求大家去躺平。他的建议是:

听到这里,你可能会觉得,这些人讲的东西是不是相互矛盾?阿莫迪讲的东西、马斯克讲的东西,跟黄仁勋讲的一样吗?我要说的是,他们讲的东西其实是一样的,并没有那么大的区别。

这里就要讲,为什么黄仁勋讲的是毒鸡汤。因为黄仁勋讲的是真的,但是并不完整。

黄仁勋都讲了什么?

但是最后有半句他没讲,是什么?他活下来了。

他现在可以站在这里跟大家灌毒鸡汤,是因为他活下来了。他是一个幸存者。

这就是幸存者偏差。剩下那些人没有活下来。有没有起得比他早的?有。有没有干得比他苦的?有。有没有遇到比他更难的问题的?也有。但是那些人没有活下来,只有他活下来了。所以我们现在听的是幸存者给大家讲的故事。

幸存者讲的故事,一定是对的,但一定是不完整的。他不会专门讲一些错的东西给你,不会有这样的。但是剩下那些人遇到了什么,他不会告诉你。而且大家要注意一点,幸存者永远是少数。

我们今天听幸存者讲“我当年努力了,我当年怎么怎么样”,就跟你去听成功学一样:我当年是怎么成功的,我当年是怎么怎么样的。你照他那样学就能成功吗?别扯了,这就是成功学。

但是他也会告诉你,你一定要吃这个苦,你一定要注重这种微小的晋升,你一定要设想这些困难,而且最后的困难可能会比你想的还要更难,但是你要活下来。这是黄仁勋反复强调的。他说我就是要活下去,你们也要活下去。

所以这就是这碗毒鸡汤最真实的地方。它不是假话,它只是把最残酷的一半藏起来了。

最后我们回到黄仁勋在卡耐基梅隆大学的结束语。他最后说的是,把你们的心投入到工作中,去创造一些配得上你们所受教育、你们的潜力,以及那些在世界相信你们之前就已经相信你们的人的东西。

什么是“在世界相信你们之前就相信你们的”?就是你们的父母、你们的老师、你们的朋友。

这句话讲得非常好,但也非常沉重。因为它背后其实不是“未来一定会奖励努力的人”,或者“你们一定能够成功”,而是未来不可知,你至少要以一种像幸存者一样的方式存活下去。

所有人都会死,但是我们从小受到的教育,都是应该如何过好这一辈子,如何不要输在起跑线上。这就是中国大家长式的毒鸡汤。

AI 时代也一样。阿莫迪提醒他们,工作可能消失;马斯克提醒我们,技术可能失控;莫高达特提醒我们,社会可能会进入地狱期;黄仁勋提醒我们,不要被恐惧钉在原地,先跑起来再说。这些话放在一起,才是比较接近完整现实的。

所以这场演讲里,黄仁勋没有给出一份安全说明书,不是说你们从卡耐基梅隆大学毕业了,这是美国名校,你们就一定是棒棒的。他给的是一碗幸存者煮出来的毒鸡汤。

有毒,是因为它来自于幸存者偏差。有用,是因为在一个不确定的时代,完全不喝鸡汤的人,可能连站起来的勇气都没有。关键不是把它当成真理,而是要知道它缺什么,然后带着清醒,把该学的工具学起来,把该做的事情做起来。

至于能不能活到最后,谁也不能保证。但至少,别站在原地等着未来来审判你。

2026-05-12 10:44:31

你们真的关心它到底是谁吗?这其实是一场彻头彻尾的、由 AI 引发的鸡飞狗跳的猎巫事件。

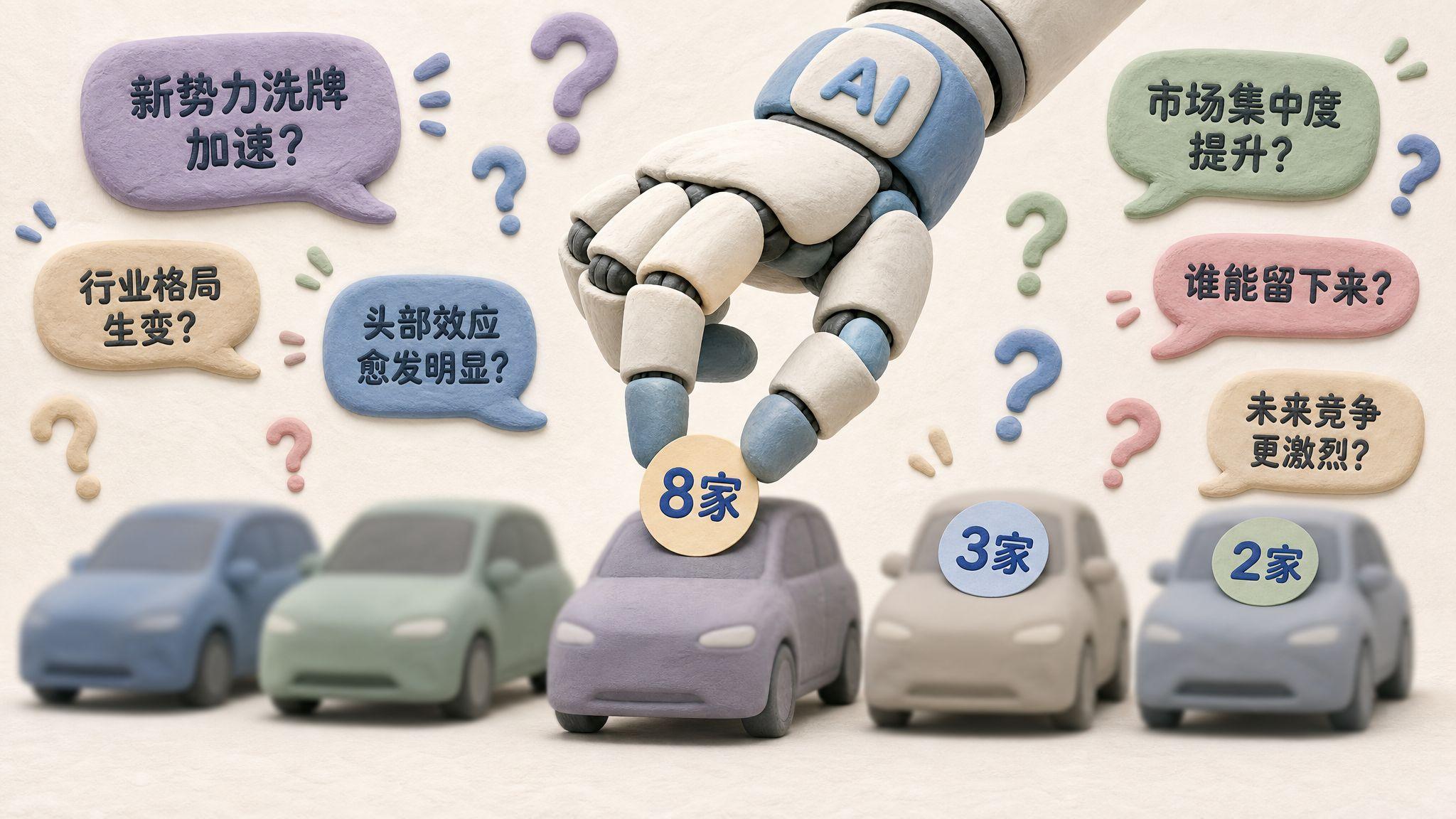

这条新闻其实是一条旧闻,最早在 4 月份就开始传播了,但是当时并没有爆。5 月 8 号,因为改了一个标题,而且大概率是由 AI 改的标题,这件事情就直接爆了。它变成了“8 家新能源车企被约谈,3 家被立案,两家撤回 OTA”。OTA 就是一种线上升级。

更离谱的是,AI 还帮你补齐了 8 家的名单。最后,比亚迪、小鹏、蔚来、理想、特斯拉、问界、极氪、广汽埃安,一堆车企出来辟谣,说不是我,我最近没有被约谈。甚至还有人问我,小米被约谈了没有。

这个事是这样:要想锁电,通常这个车要卖很长时间以后才有这样的需求,新车是不需要锁电的。小米属于后来者,在这个行业里卖车没卖几天,所以小米没有那种特别旧的车需要去做锁电操作。这一次,小米也没有出来辟谣。至于小米有没有被约谈过,谁也不知道,因为从来就没有公布过名单。

所以这一期压根讲的就不是锁电的事情,真正要讲的是:AI 怎么把一条没有名单的旧报道,变成了一场整个车圈鸡飞狗跳的猎巫事件?

首先说一下原始报道到底是怎么回事。这个报道是 4 月 17 号发的,由央视网微信公众号发布。这确实是央媒发的,标题是《一个月内投诉超过 1.2 万件,同比上涨 273%,新能源车这个顽疾到底该怎么治?》

这里头有一些数字:第一个是 1.2 万件,第二个是同比上涨 273%。而且这个数据是 2026 年 3 月份一个月在 12315 平台上的投诉。它报道的事情叫锁电。大家注意,它在标题里压根就没有写“锁电”这件事,标题里写的是“新能源车这个顽疾到底该怎么治”。

主要讲的是,有些人早上起来,厂家推送了一个 OTA 安装包,他就给安装了。安装上去以后发现不对:我原来可以续航 500 公里的车,怎么就变成只能跑 300 公里了?

当时这个文章没有火的原因,是大家觉得这个事跟我没什么关系。新能源车圈里有一个东西叫锁电,而锁电又不是特别新鲜的事情。因为大家最早了解到锁电,应该是从苹果那来的。苹果因为锁电被欧洲罚过,在国内应该也被约谈过。

苹果每过一段时间,就会把比较陈旧的苹果手机的电池容量锁住,让待机变得稍微短一些。一方面是保护电池,保护手机;另外一方面也是让你去买新机器。而且苹果还特别过分,它不光会锁电,还会让你的机器变得很慢。它可能通过升级系统,让你的机器整个变慢,就是逼着你去买机器。

现在车企也开始锁电。车企锁电被约谈,比较确认的一个是广汽,另外一个是特斯拉。特斯拉不光在中国被谈过,在海外也被约谈过。

那么锁电是怎么个锁法?它锁几样东西。

电池在充电的时候会发热,在放电的时候也会发热。放电如果是慢慢地放,问题不大;如果快一点放,那一定会发热。我们以前使用干电池的时候,如果电池短路了,你把电池正极负极接一块,那个电池很快就会热起来,然后会流汤。后来锂电池这块会好一点。

另外一个电池发热的时间点,就是充电的时候。现在都在拼命搞快充,800 伏快充、1000 伏快充。怎么快充?就是把电压提高,提高以后快速把电流充进去,这个时候电池一定在疯狂发热。

那怎么做热管理?就是在电池里头搁一个温度计,如果发现温度上升了,原来比如可以让它上升到 50 度,上升到 50 度以后再把充放电功率下降。现在可能上升到 40 度,就给你把充放电功率下降下来,给你锁住。

所以用户经常会遇到这样的问题:

4 月份没有爆,因为这个事跟每个人有关系吗?也有点关系,但关系并没有那么大。它选用的两个数字,1.2 万件和 273%,数字虽然很大,但是并没有引起大家的共鸣。这个标题并不好传播。

但是到 5 月 8 号,事情就发生了改变。5 月 8 号,有一个媒体叫 IT 之家。我以前还跟他们做过好多活动。IT 之家把这一篇央视网微信公众号的文章拿回来改写了一遍,后边还写了引用出处,说引用了央视网的文章。因为现在要求你必须写出处。

写完以后,它就把标题改了。标题变成了《8 家新能源车企 OTA 锁电被约谈,工信部明确四大禁令》。

你看,这里第一个是“8 家”,它给了一个非常明确的数字,不是 1.2 万,不是 273%,而是 8 家。而且它把这个事到底是怎么回事说出来了,叫“OTA 锁电被约谈”。央视网那个叫“新能源车顽疾”,没有告诉你具体是什么事。

“8 家”,事情告诉你了,后边还写了一个“工信部明确四大禁令”。其实后半截这个标题起得并不好。再往后传播,这个标题就又变了。因为“8 家”这个文章出来以后,事情就开始爆发了。再往后改,标题就变成了“8 家被约谈,3 家被立案,两家撤回 OTA”。这些数字放上去以后,这个新闻一下就爆发了。

这个标题典型是 AI 写的。其实前面央视网的标题应该也是 AI 写的。因为我自己做 YouTube,每一条视频也需要写标题,我的标题经常是让 GPT 去写。每一次它给我写四五个标题,里头比如有反差感标题,有知识型标题,每一次一定会有一个标题叫数字标题。就是你要尽量在标题里写数字,因为人比较手贱,一旦看见标题里有数,就喜欢点进去,它的点击率会上升。

但是一定要注意,这个数字要跟人有关系。你如果像前面那个写 1.2 万件的标题,大家点进去的感觉就会少一些。那你说只有数字就会火吗?当然不是。前面那个数字没火,这次改成 8 家就火了。真正燃烧起来的其实并不是数字,而是人的心理。

我记得在 HBO 神剧《切尔诺贝利》开头的时候,有一段很重的独白,是主人公在自杀之前念的一段独白:

谎言真正可怕的地方,不是我们一时把假话当真,而是因为听过太多谎言之后,我们会失去辨别真相的能力。当真相已经被谎言淹没,人们就会放弃追问真相,而满足于一个个故事。在这些故事里,谁是英雄并不重要,大家真正想知道的只剩下一件事情:到底该怪谁?

这次就是这样的一个事情。前面想给大家普及一些事情,想给大家说一些数据,想告诉大家这个事情有多么严重,没有人关心。当告诉大家说有 8 家被约谈的时候,观众一看就说:到底是谁?我们到底应该骂谁?

所以为什么我前面说,这是一次猎巫事件。用户不关心真相,不关心什么是锁电,不关心 12315 投诉到底说了什么,不关心车企锁电到底是怎么回事。大家只在问:

这就是数字标题真正可怕的地方。它一旦击中了用户的心理,马上就会爆发。

那你说现在是不是一个谎言满天飞的时代,大家已经分不清真相了?因为 AI,你真的搞不清楚哪个是真的,哪个是假的。

为什么不点名反而更加可怕?这里跟大家讲一个学校的故事。

某大学因为在校生怀孕和堕胎的数字不断上升,老师每次都苦口婆心地劝这些大学生:你们要洁身自好,千万不要去做一些事情,要注意防护。讲到这样的程度了,但是没有效果。年轻人嘛,总是要去犯错误的。

有一次,学校的教导主任说,来,我去试试。开学就开始讲:今年我们招收的学生里,有两个人,大家注意,不是一个,是两个人,是艾滋病病毒的携带者。但是为了保护他们的隐私,我们就不公布名字了。

他搞这么一个事情,后面就是寒蝉效应了。大家还敢不敢再随随便便地发生一些事情?肯定不敢了。谁也不会在脑门上贴着说我是艾滋病。那么你再去跟别人发生关系之前,你说你是吗?我不是。你信吗?这事就会变成这样。

所以不公布名字反而会更能够传播,大家心里都会记住这个事情,而且更有效。像这一次,如果央视网直接告诉大家到底是谁,那么这个被点名的今年就别卖车了,一下就臭名声了。如果不点名,那么所有车企都倒霉。

所以为什么我反复强调这次叫猎巫事件。猎巫的时候,你知道谁是女巫吗?你也不知道。他们只是写上《女巫之锤》这样一本书,然后告诉你,如果你发现身边的女性有文化、识字,或者什么样的情况,她就有可能是女巫,她可能在诅咒你。所以不公布名字更可怕。

最后这些车企没办法,只能出来辟谣。而且辟谣的效果其实也很一般。你现在辟谣也只能讲,我最近没有被约谈,我最近没有被立案。你说你造了这么多年车,中间有没有被约谈过,有没有被立案过,这事其实谁也说不清楚。

你说我做了这么多年车企,从来没有跟政府打过交道,这不是扯淡吗?特别是比如比亚迪,现在在街上看到出事,大家猜比亚迪一般都没问题,为什么?它卖的车多,一个月卖 30 多万辆车,整个占有量是最高的。至于特斯拉,这个事可能性更大。为什么?因为它是开山鼻祖,从最早开始就是它出各种问题,在它身上出的概率都是最高的。

最后大家辟谣也辟了,但也就这样,没什么效果。

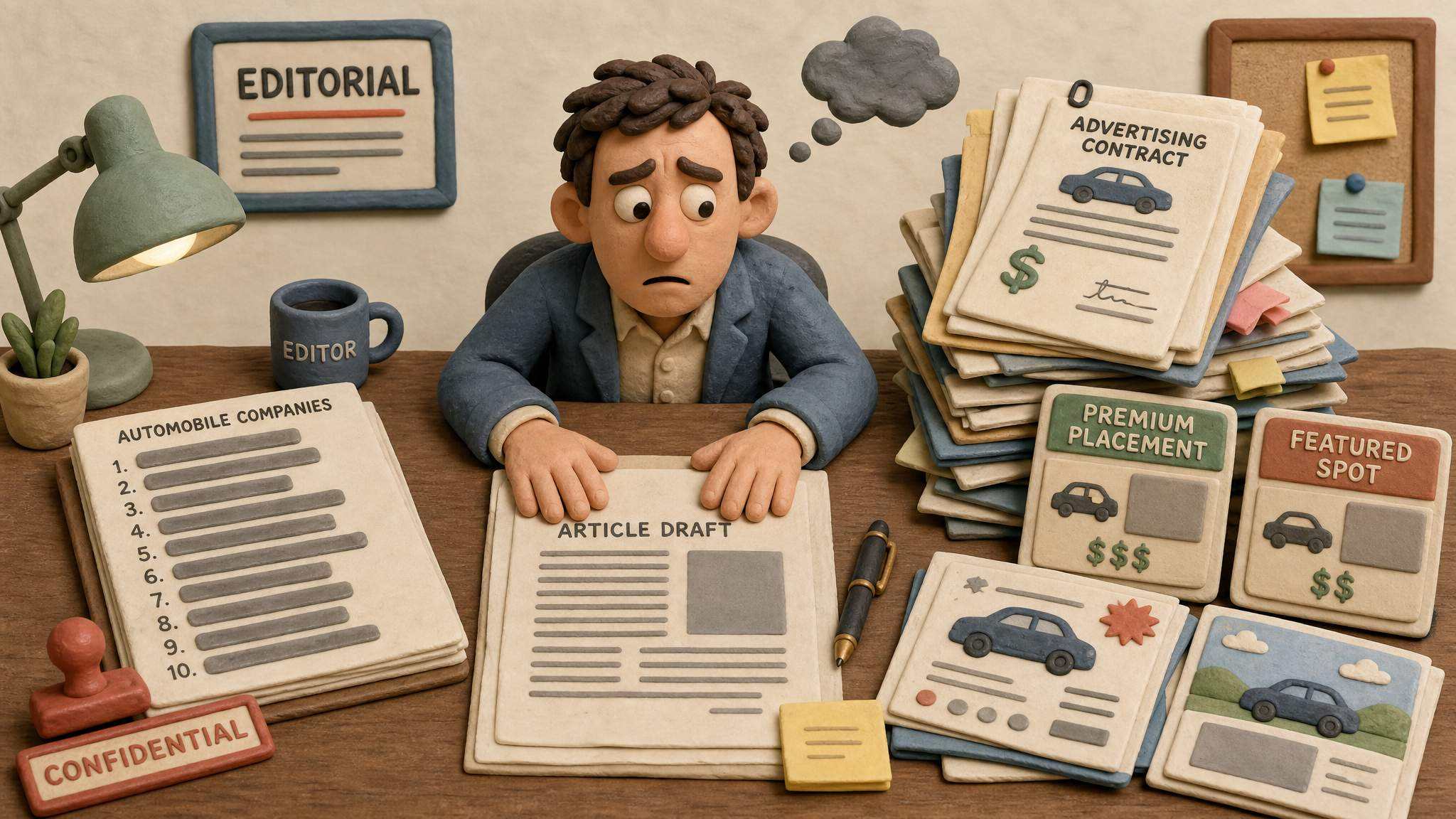

出了这样的问题以后,央视网也得出来解释。我原来发了一篇文章,现在造成了巨大的社会影响。大家注意,在中国,这些媒体希望自己发的文章火,但是又不希望自己发的文章太火。一旦出了圈,你控制不住了,大家都出来找你来了,那这事你也没法整。最后它也需要去收拾这个东西。

那你说把这名单公布了不就完了吗?它公布不了,因为都给过钱了。这些媒体写文章以后,要点名一定是要跟人说的,说我要点你的名了。车企也是要上来公关的,我要上你这来打广告,给钱实际上是通过打广告,并不是贿赂。我打了广告,你就不能点我的名字。会出现这样的情况。

都给过钱。而且现在汽车行业,特别是新能源汽车行业,是所有新闻媒体的大广告主。现在可能他们是最大的广告主,谁也不能得罪。得罪了你以后,你不在我这打广告了,那我这个媒体就混不下去了。你别看它叫央视网,它也是要靠广告费来盈利的。所以这个名字是不能写的。

继续往下混,这个事又过不去了。最后央视网出来讲,说我们澄清一下。不是澄清是谁,它说这个名字我们就不公布了,但是“8 家被约谈、两家撤回 OTA、三家被立案”的企业,是我们统计了 6 年的数据,是从 2020 年到 2026 年这 6 年多的数据,不完全统计,不止这 8 家,还有其他人。

所以我说那个数有可能也是 AI 写的,它压根也不知道具体是谁,反正就写了这么个数。前面那些辟谣,也只能辟说我近期没有被约谈,我近期没有被立案。所以最后大家抹了一把稀泥,算是抹过去了。事情也就这样结尾了。

但是这件事情真正给我们的启示是什么?AI 时代,模糊信息会自动长出獠牙来。

你让 AI 帮你起标题,你要求的是什么?你不会要求 AI 给你起一个最贴切的标题。你的提示词一定会写上:请 AI 帮我起一个高点击率的标题吧。即使你不这么写提示词,腾讯也好,字节跳动也好,他们会自动帮你起标题。起完以后会进行 AB 测试,到底哪个标题好,哪个标题不好,然后会选一个点击率最高的标题给你。

像我现在 YouTube 的视频,每次都是起三个标题。在视频公开以后,大概两个小时左右,YouTube 会给我统计哪一个点击率高,然后把这个标题留下来,剩下两个标题删掉。

现在 AI 就会自动给你起这种带反差、带数字的标题,想着怎么命中用户的心理点,让这个新闻能够爆起来。而且你给了一个模糊信息之后,AI 还会有幻觉。它会把过往谁谁谁被约谈的这些信息都找出来,找完以后去拼凑,说有可能是张三被约谈了,李四被约谈了,特斯拉被约谈了,比亚迪被约谈了。它会把这些东西都拼起来,甚至还给你拼出 8 家来。

特别是你使用豆包这种不是那么聪明的模型的时候。因为我就是这么干的。5 月 8 号那天,问豆包到底是谁,当时还没有出来辟谣,它就给我列了这个名单。而且我前两天在 X 上还说这件事:怎么说有 8 家被约谈,也不说是谁呢?然后一帮人还在下头骂,说你不仔细看吗?人家都写了,就这 8 家,而且两家是谁、三家是谁都给我列出来了。他们也都被 AI 骗了。

所以这个故事真正给我们的启示是,AI 时代已经来了。我们再看到任何信息的时候,不要着急跳起来说我要去骂人,不要干这个事情。而是要想一想:这个数据是怎么来的?这个信息、这个内容是怎么来的?

我们现在所看到的内容,200%、1000% 都经过 AI 的处理。目的不是为了让数据更准确,让内容更完整,而是为了让我们能够有更高的点击,有更高的完播。就是你要把这个视频看完,要把整篇文章读完。它在做这样的事情。因为你看完视频的过程可以多放两条广告,看完文章的过程也可以多放两条广告。

所以我们所有人看到的这些信息,都是被“多放两条广告”这样一个非常朴素的目标修改过的信息。

最后的结论,这就是一次由 AI 带来的、一地鸡毛的猎巫行动。

大家知道猎巫是怎么来的吗?黑暗的中世纪,对有知识女性的一次迫害。黑暗的中世纪,由宗教裁判所带来的,对有知识女性的一次整个社会的迫害。

猎巫跟这一次有一个很一致的点,就是猎巫来自于信息传播方式的革命。这一次是 AI 革命,上一次是印刷术的普及。印刷术普及以后,确实有很多科技文献、文学作品、《圣经》被印刷,但是这些书并没有被大量传播。真正被大量传播的一本书叫《女巫之锤》。

那是一本非常低俗的书,上面写的是你应该如何去鉴别身边的女性是不是女巫。如果你怀疑她是女巫了,你可以如何对她们进行刑讯逼供。它写得非常具体:应该如何处罚这些女巫,如何消灭她们。

这本书被广泛传播以后,带来了中世纪的猎巫。那么这一次,由 AI 和推荐算法带来的变化,带来了这一次车圈猎巫。

2026-05-11 21:40:54

大家好,欢迎收看老范讲故事的 YouTube 频道。今天咱们来讲一讲“以毒攻毒”:用 Vibe Coding 治疗网瘾,AI 时代的新选择。

大家注意,这个名字听起来稍微有点标题党。网瘾是一个很严肃的问题:孩子沉迷游戏,或者刷短视频,昼夜颠倒,不写作业,不出门,不社交,家长急得不行。你现在说再给他一个 AI 编程工具,让他继续坐在电脑前面,继续盯着屏幕,继续熬夜折腾,这不是火上浇油吗?

所以我要先把今天的核心观点讲清楚。我不是说 Vibe Coding 能够完全替代程序员,这不是今天的主题;也不是说孩子学了 Vibe Coding 以后,明天就可以上硅谷年入百万。今天咱们要讨论的是:如果一个孩子已经沉迷游戏了,已经刷短视频、沉迷二次元,很难从屏幕世界里边直接揪出来了,那么有没有可能,不是先把他从屏幕前头拉走,而是把他的注意力从一种消费型的成瘾,迁移到一种创造型的成瘾上?

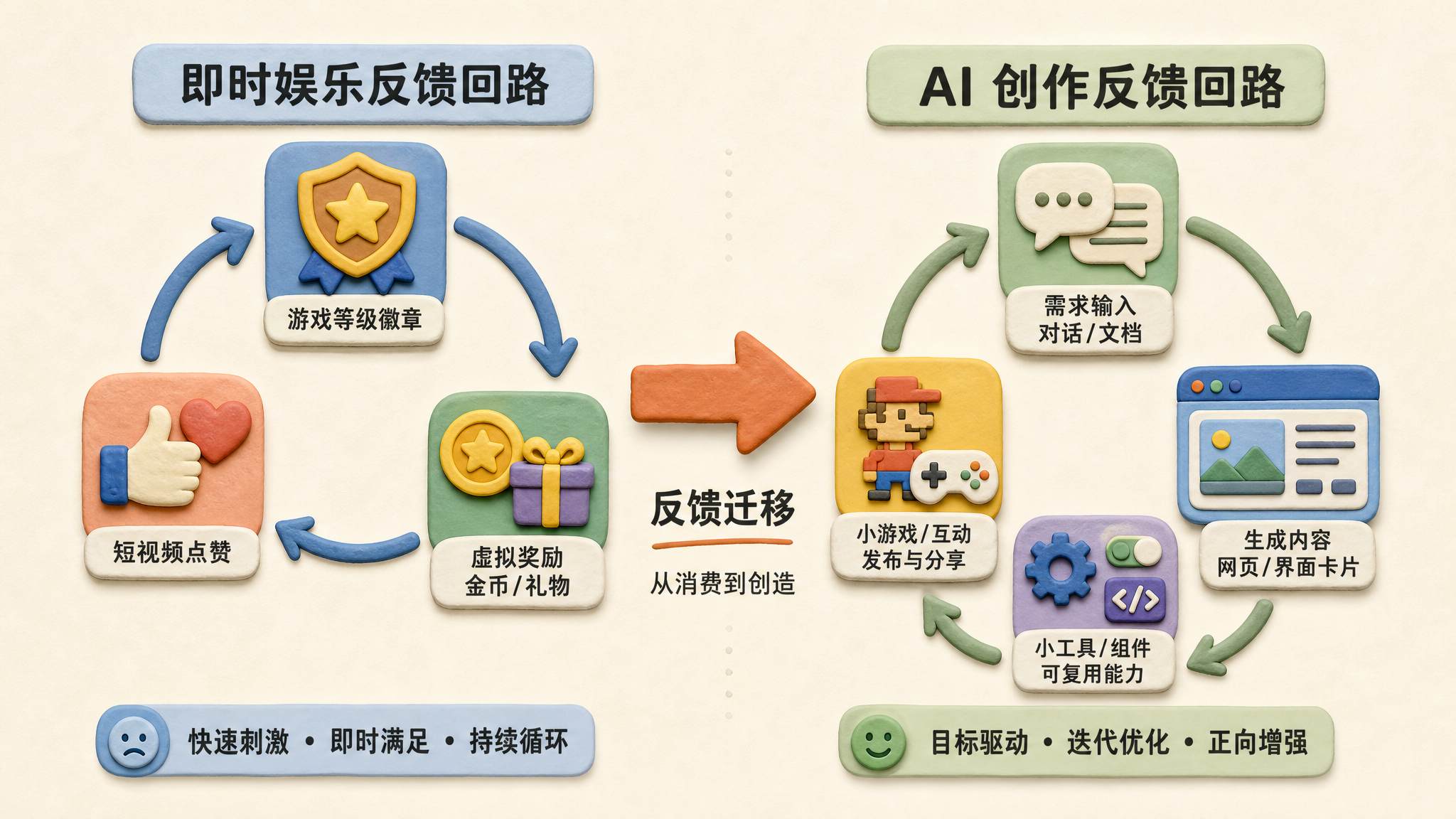

所以咱们的标题叫“以毒攻毒”,咱们也没说 Vibe Coding 就是一个多么健康的事情。游戏和短视频给的是即时反馈,Vibe Coding 其实给的也是即时反馈。游戏和短视频让人沉浸、让人上瘾,Vibe Coding 其实也让人上瘾。游戏和短视频会把人困在平台设计好的反馈回路里头,Vibe Coding 则是把人带到一个现实世界的创造反馈回路里。还是要不断给他一些强刺激,说你干得不错,然后他会继续留下来。

这个话题也不是老范自己拍脑袋想出来的,而是一位硅谷著名的传奇投资人的播客给了我一些启示。这个人叫纳瓦尔。他最新的一期播客里,其实并没有直接讲这个话题,而是讲自己怎么在这么多年以后重新回去写程序。他这个播客的名字叫 A Return to Code,就是“我又回到写程序这个事情上去了”。

这哥们是学计算机的,但是做投资人,肯定很长时间不接触代码了,现在又回来写程序。他讲到,真正有创造力、有自驱力、有表达能力、有清晰愿景的人,会有新的工作机会。今天咱们要讲的 Vibe Coding 像电子游戏一样容易上瘾,但是它的奖励不是假的,而是真实世界里边真实有价值的东西。

我们以前讨论网瘾,总是想着怎么把孩子从游戏里边揪出来。但是游戏为什么能让孩子上瘾?包括短视频,现在短视频其实比游戏还上瘾,短视频为什么能够让人停不下来?本质上,有几个因素凑在一起:

Vibe Coding 居然也具备所有这些特征,甚至比这个还要更强一些。Vibe Coding 跟前面这些网瘾的唯一区别就是,它产出的东西不是游戏等级,不是短视频里的赞,而是一个真实的网页、一个小工具、一个小游戏、一个小脚本,甚至是一个小应用。它产生真实的价值。

首先,治疗网瘾这件事一直是一个很有争议的事情,因为它没有一个特别有效、特别科学的方法,甚至还出现过一些让人没法看的事情。先说一个很现实的问题:网瘾到底怎么治?

过去 20 多年,很多家庭都在被这个问题所困扰。我们回头来看,所有所谓的治疗网瘾的方法,其实都非常粗暴。有些地方搞封闭式训练,把孩子关起来,体罚、羞辱、强制劳动、军事化管理,还有一些更极端的案例,直接进行电击、暴力管教,训练营据说还有死亡事件发生。

这些事情为什么会发生?因为家长焦虑。家长看着孩子沉迷游戏,会觉得这个孩子要完了。特别是在中国,输在起跑线上了,他不读书、不工作、不社交、不运动、不睡觉,这怎么行?家长当然就慌了。

但是问题是什么?焦虑的家长很容易相信一个简单粗暴的方案:把手机抢走,把电脑砸了,把孩子关起来,强行戒断。他以为这东西像戒毒一样,其实真的不太一样。因为很多时候,孩子的问题不是屏幕本身,屏幕只是个出口。真正的问题可能是,他在现实世界里长期得不到正反馈,在学校里只有失败和羞辱,在家里也只有指责和比较。“你看别人家小明怎么怎么样。”他不知道自己擅长什么,也没有一个可以投入的现实目标。他一离开游戏,就只剩下空虚了,啥也没剩下。

所以你把游戏给他拿走,问题并不会自动消失,你只是把一个出口堵住了。如果没有新的出口,他可能会转向短视频;短视频堵住了,他可能会转向小说;小说堵住了,他可能再转向饭圈,或者彻底躺平。现在很多人说:“我没有任何欲望,我就准备躺这了。”

这就是为什么我要说,治疗网瘾一直没有一个特别简单、特别有效、特别科学的方法。它不是一个按钮,按下去就好了。它更像是一个迁移过程:从低价值的反馈迁移到高价值的反馈,从纯消费迁移到半创造,从算法喂养迁移到主动提出问题,从“我今天刷到了什么”,迁移到“我今天做出了什么”。这才是今天咱们要讨论 Vibe Coding 的意义。

那么到底什么是网瘾?这个定义本身其实也有一些争议。网瘾这个词在中文语境里经常被滥用,好像孩子开始打游戏了,家长就说他有网瘾;孩子周末多刷了几条短视频,家长就说他有网瘾。但是从医学和公共卫生角度上,这个事情是有严格标准的。

世界卫生组织专门有这个病,叫做游戏障碍。它有三个核心条件:

这点非常重要,因为我们不能把所有孩子对数字娱乐的兴趣都病理化,都认为这事有病。一个孩子喜欢游戏、喜欢动漫、喜欢刷视频,未必是病。问题在于这件事情有没有挤压他的现实生活,有没有破坏他的自我控制,有没有让他长期丧失学习、工作、社交和生活的能力。如果没有,那就是兴趣;如果有,那可能就稍微需要干预一下了。

所以今天我们说用 Vibe Coding 治疗网瘾,不是说 Vibe Coding 是医疗疗法,更不是说它可以替代专业的心理咨询、精神科诊疗、家庭关系修复。我说的是一个家庭教育和数字习惯迁移的思路:当一个孩子已经被低价值的数字产品牢牢吸引住的时候,不要只想着强制断网或者抢他手机,要尝试着引导他到一个同样有吸引力,但是能产生现实价值的方向上去。这个方向就是今天咱们要讲的 Vibe Coding。

常见的网瘾机制,就是为什么大家觉得游戏和短视频这些数字产品会让人上瘾?因为这些东西都是靠数学模型拿捏人的能力边界的。真的是世界上最聪明的一帮人在研究怎么让你上瘾。

游戏有任务、有等级、有装备、有队友、有技能,它是一套完整的世界观。短视频没有那么复杂,它也不要求让你循序渐进,而是给你一个更短、更快的反馈。刷一条不喜欢,我再给你一条你喜欢的;刷完以后再接着刷。它的反馈更快,但是没有形成完整世界观,没有这种梯度。它们是两个不同的玩法,但底层有类似的东西,就是即时反馈和持续调整。

调整什么?游戏不是随便设计的。它会让你刚开始的时候很容易赢:新手村、新手引导,给你简单任务,怪物也很弱,奖励也很密集,让你快速建立起“我能行”的感觉。刚才咱们讲了,很多小孩形成网瘾的原因是他们在外边没有办法得到认可,那你到游戏里头说:“哎,我行了。”

等你熟悉了以后,等级和难度会逐渐上升,怪会变强,副本会变复杂,装备会更加精细,角色成长线会拉长。你会不断遇到一个刚好能够得着的目标,这叫能力边界。它会不断摸索你的能力边界。太简单,你觉得没劲;太难,你直接有挫败感。现实生活已经这么难了,我为什么要到游戏里受折磨?就直接弃坑了。所以它一定要找到“刚刚好”,你稍微努努力就能够得着。

其实很多教育学也在讲这个事,我们要设置一个能力边界,让他刚刚好够得着。但是通常老师没这个耐心,老师也有自己的 KPI。

短视频跟游戏这套东西不太一样。它不会要求你升级,它只是每一次来猜,你下一条最喜欢看什么。我尽可能更集中、更快速地给你进行反馈。所以短视频的危害形式要比游戏大,要注意这一点。

游戏和短视频厉害的地方就在于,它不只是一个娱乐产品,它是一个非常巨大规模的反馈机器。它通过即时满足、随机奖励、社群身份、等级系统、算法推荐,不断把人留在系统里边。

最后的问题就来了:孩子们不是简单地不自律,他是在用一个普通人的意志力,对抗一个由产品经理、游戏设计师、增长团队、推荐算法、商业化团队共同打造的超级系统。甚至这些超级系统里很多人,都是年薪好几百万的科学家。你要让人从这里边逃出来,不能简单靠一句“你别玩了”,这个事是很难成功的。

我们必须要找一个更聪明的办法。你说有没有这种聪明办法?其实有过。

清末虽然鸦片战争已经打过了,虎门销烟也过去了,清朝也禁烟了,甚至英国也跟我们一块去开了禁烟大会。当然英国跟中国开禁烟大会的原因比较奇怪,因为后来中国反向出口鸦片,把英国也祸害了,英国说不行了,我们禁烟吧。

但是清朝政府自己的治理能力和治理效率是比较低下的,所以鸦片依然泛滥。最后没有办法,一方面这东西很上瘾,另外一方面,地方政府和很多门阀势力要靠鸦片赚钱,所以必须要种鸦片。最后他们用了一个什么方法把这个事情解决掉,或者说部分解决掉?上卷烟。

上了卷烟以后,你也可以上个瘾,稍微替代一下,没有鸦片的危害那么大。而且各级政府相对来说还有收入,因为卷烟可以收税,卷烟是一个税很重的产业。所以它算是一个成瘾替代的过程。

这也是我们今天讲这个故事的一个原因。小孩有网瘾了怎么办?我们希望立刻把孩子拎出来,变成一个热爱学习、热爱运动、热爱社交,每天早睡早起、积极向上的完美青年,这可能吗?家长们,你自己照照镜子,你自己是这样的人吗?我们大部分人其实也做不到这一点,那么就别要求孩子干成这样的事情。

所以我们今天就要稍微让他换一下,让他用 Vibe Coding 来替代打游戏。很多人说,写程序这事看着挺痛苦的,程序员都是秃头。当然像老范这个头发还是不错的。很多程序员都是未老先衰,很年轻的程序员看着都很老。你怎么说 Vibe Coding 或者写程序上瘾呢?

其实写程序真的是上瘾。如果你没写过程序,你可能很难理解,因为写程序是一种心流状态,它在不断解决问题。而 Vibe Coding 要比写程序还要上瘾。就像卷烟替代鸦片一样,我们现在就希望用它来替代打游戏。

下面咱们来讲今天真正的核心:Vibe Coding 为什么会上瘾?很多不写代码的人其实很难理解,他们以为写程序是一件特别枯燥的事情,屏幕上甭管是白底黑字还是黑底白字,看着就头大。你需要学编程语言,需要学语法、变量、函数、对象,要学一大堆东西。

现在你只需要跟 AI 说:“我要一个什么什么东西。”就像上帝说要有光,于是就有了光那样的感觉。所以 Vibe Coding 等于直接把第一道门槛去掉了。它可以让人从一句话开始:“帮我做一个记账的小程序。”“帮我做一个背单词的小游戏。”第一版可能比较粗糙,但是它能跑,也能有一些效果。这不就是一个正反馈吗?跟打游戏那过程不是一样吗?

它一旦跑起来,这个人就觉得:“我是不是改一改?按钮不太好看,有点丑,咱改一下吧。这个颜色太丑了,咱改一下吧。”当你改的时候,你就相当于在游戏里从新手村出来,稍微往前走一走,在周围稍微探索一下。你的编程任务就可以一个一个地像游戏那样进行下去。而每一次任务的成功,就相当于你解决了一个问题,又得到了一个反馈,相当于又打了一个怪。

所以 Vibe Coding 是非常成瘾的,而且它把前面这些基础知识的门槛给你去了。小孩也都可以很好地使用 Vibe Coding 写出程序来。而且你直接跟它说中文、说英文、说各种语言,它都老老实实给你写程序,这还是非常爽的一件事情。

过去其实也有少儿编程课,但是门槛很高。我也投过少儿编程的项目,比如编程猫,我还给我儿子报过。报了以后他也没什么兴趣,学了半天,你的付出跟反馈不匹配。我折腾了半天,最后做出来那个小程序不好玩。

为什么会不好玩?原因很简单,它需要把课程设计得适合所有人,每个人的进度是不一样的。你需要学一堆基础知识,很快兴趣就没有了。所以当时编程猫的课程付了费以后也没上完。

原来这些东西有价值,不能说没有价值。但是问题是什么?真正长期坚持下来的孩子非常少。原因是你还是要去学编程语言,还是要去学符号系统。即使是 Scratch 这种用积木拖的代码,它确实很形象,就是一堆积木拼起来,但是你还是要了解加减乘除、赋值、排序、存储、循环、判断,还是要搞这些东西,还是很麻烦。而且你用 Scratch 这种积木语言拼出来的代码,能干的事情很有限,大部分事情干不了。

不像现在,我可以提一个很现实的问题:我现在想要一个记菜谱的程序,或者我现在追星,我特别喜欢哪个明星,请帮我把这个明星的所有信息都搜集起来,让我可以给他做一个明星记事本。一句话我就可以把这事搞定了。以前你学了半天 Scratch,你要想做出这样的东西来,得学几年。

所以孩子还没有看到成就,就直接被复杂的编程语言把兴趣给磨没了。现在的话,你会说就可以了,语法也不需要严谨。即使是 Scratch 那种拼积木的,你的语法还是要严谨,还是要 debug,还是会出错。更别说 Python、JavaScript 或者其他语言。现在我写中文跟 AI 聊天,写英文跟 AI 聊天,我语法错了,写错别字了,单词拼错了,有什么关系?没关系。

这个事情对孩子非常重要。很多孩子不是没想法,只是他觉得不太敢表达:我说了,万一说错了怎么办?这个叫挫败感。他也害怕我万一把这个想法说出来,老师说你这怎么这么幼稚,或者同学笑话他,或者父母说这玩意有什么用。这个对于他来说压力是很大的。

但是 AI 不会干这活。你跟 AI 说什么,AI 都不会笑话你。AI 会说:“行,我给你做一版。”很多孩子在现实世界里最缺的其实不是知识,而是一个愿意把他的想法当回事的对象。在这件事情上,AI 要比父母、比老师、比他的同学做得都要好,所以更容易上瘾一点点。

而且 AI 会不停地告诉他:“你这个想法可以实现,没问题的。”这对一个长期沉迷游戏、觉得现实世界没有正反馈的孩子来说,非常重要。

游戏让人上瘾的还有一个原因,就是难度刚刚好。Vibe Coding 也是一个天然具备难度适配结构的东西。

一个好游戏,动态难度一定是动态设定的。太容易了,玩家就跑了;太难了,新手就不来了。所以游戏设计里有很多机制,就是为了让不同程度的玩家有他们自己可玩的东西。

但是游戏比较麻烦的是什么?因为它一发售就写死了,有些人可能会高不成低不就,没法找到自己合适的地方,那他就会离开。Vibe Coding 这件事,一个完全不懂计算机的人,让 AI 帮他做个小工具,第一版就出来了,第一波奖励到手了。

然后他发现,我这个程序在电脑上好好的,怎么到手机上就这么丑?你把这个问题提给 AI 以后,AI 会告诉你,有一个东西叫响应式设计,就是在不同的屏幕大小上会自动适应。你原来没用这个东西,这个东西大概是怎么回事。然后你说我们用一用吧,它等于就升了一级,而且是你自己提出的问题,不用让 AI 猜你到底会什么、不会什么。

再往后说,我想把这个东西本地持久化一下。什么意思?就是我不希望每次打开应用以后,数据都没有了,我需要把东西存起来。AI 就会告诉你,什么叫本地存储,什么叫持久化,什么叫后端服务,什么叫数据库。你学了半天以后说,哦,我又学会一点东西,又把这个问题解决了,又一波奖励到手了。

再往后说,不光我自己想用,我还想给我朋友用,这事怎么办?你问 AI,AI 告诉你,你需要把它部署到云服务器上去。搁在自己电脑上,别人用不了。部署到云服务器以后,你还要给它申请个域名。你不希望别人乱用,可能还要登录;登录以后可能还有权限,因为现在不是你一个人用了。后台可能只有你一个人能看到,其他人能用前台的服务就可以了。等于你又学了一堆知识,又一波奖励到手。

它是这样的一个打怪升级过程。每一次你遇到的问题,正好是你现在知识上缺的这点。它不会给你做这种系统化教育。像我们原来学编程都是系统化教育,先学变量,再学计算机架构,然后再学什么,就是这样的一个系统化。现在没有了。我先有个需求,然后根据这个需求,一步一步把这个程序越做越复杂。在这个过程中,我学会编程了。

所以这就是 Vibe Coding 最厉害的地方。它不是把知识库做成课程,系统化教给你,而是让知识藏在问题里头。你自己发现问题,你自己想去解决问题,你自己去问,问完以后它就耐心地给你解释。在这个过程中,它就慢慢让你上瘾了,让你在这个过程中还学习了。

而且它永远知道你的能力边界是什么。你的能力边界就是你问的问题,你问了什么问题,你的能力边界就在这了。所以 Vibe Coding 会让孩子在解决问题中自然学习现实的知识。

这部分很关键。很多人以为 Vibe Coding 是让 AI 写代码,如果只理解到这里就太浅了。Vibe Coding 真正的教育价值在哪?不是 AI 帮你写了多少代码,而是它会把你从一个愿望一步一步带到现实世界。

你就在这样的过程中,从一开始只想做一个简单的东西,不断往前推进,就会自然碰到现实世界的边界:网络延迟怎么办?服务器为什么要钱?用户数据怎么乱的?

这些问题比单纯上一门信息技术课要更有力量,因为这是从他自己的需求出发的,不是老师布置的。这是孩子自己碰上的。一个人只有在自己撞上墙、自己想去解决问题的时候,才有动力继续学习下去。Vibe Coding 就是一个不断制造这种温和撞墙的机器。这就是润物细无声的学习。它不需要说教,不需要像家长那样在旁边喊:“你应该学点有用的。”所以 Vibe Coding 让人上瘾,而且让人努力学习。

Vibe Coding 跟游戏还有一个很大的区别,就是游戏是有边界的,Vibe Coding 是没有边界的。在这点上,Vibe Coding 其实比游戏的成瘾性还强一些。

纳瓦尔在他的播客里有一个点让我觉得非常有意思。他讲,游戏这东西不可能让你无限地玩下去。就算是再大的开放世界游戏,它也是有边界的。原因其实很简单,游戏公司是靠卖游戏挣钱的。你如果买了一个游戏玩一辈子,再也不买第二套了,那人家不饿死了吗?

但是 Vibe Coding 不一样,它底下连接的是现实的计算机世界和计算机网络。所以理论上说,你可以让它做任何软件,你可以把软件向任何方向去升级。你可以让它做背单词工具、健身记录、家庭记账、小型游戏,也可以给同学们做社群工具。它没有一个特别固定的地图,后边无穷无尽,你可以一直让它玩下去。

所以它也没有固定任务。它不像传统游戏似的,还要设计说你应该先玩什么、后玩什么,都没有。想做什么做什么,一切都是从自己的意愿出发。Boss 无限多,你只要说我愿意打下一个 Boss,没问题,来了。它是这样的一个系统。而且每一个 Boss 打过去的过程都不是特别费劲,因为真正生成代码的是 AI,不是你自己。

纳瓦尔自己也说,他现在开始用 Vibe Coding 以后,立马上瘾,这一点都不夸张,而且是越用越上瘾。

刚才我们讲到,小孩子有网瘾,有一个很重要的原因是他害怕被拒绝。他在现实世界中有挫折感,所以愿意逃避,愿意到网络世界里去寻找新的认同。那 AI 是一个什么东西?它不会嘲笑,不会翻脸,你让它干啥它都干。

咱们就说写程序。我今天说:“你给我加一个按钮。”看完以后,按钮不太好看,“你给我把这个颜色换成红的。”红的不好看,“给我换回去吧。”我需要一个新的功能,要做什么什么东西,它就做去了。那个 AI 可能吭哧吭哧做了俩小时,写了几万行代码进去,还没有上一版好用呢,你说“给我退回去”。如果后边是个人会怎么样?后边是个人早给你疯了。但是 AI 不会干这个,你说什么它就给你干什么。

而且 AI 还有一点,AI 大部分是讨好型人格。因为 AI 自己经常容易出现幻觉,它也知道自己说的东西不是特别靠谱,所以只要人不是错得特别过分,它都会说:“没问题,你是对的,我接着给你做。”所以 AI 在孩子面前会让孩子有一个非常安全的表达环境。

像我儿子有时候在我面前也是不太敢说话,因为怕我挑他错。我原来是有给人挑毛病的习惯,这确实要承认。说点什么事,我说:“你这样说对吗?你的逻辑清楚吗?”然后他就会觉得压力很大。AI 不会跟你说这个。

讲到这,很多家长就晕菜了,说老范你这不对,你找了一个更上瘾的东西回来。孩子原来就沉迷游戏,你现在让他沉迷 Vibe Coding。

所以我要把话说完整:Vibe Coding 不是万能药,不能自动解决孩子不社交的问题,也不能解决焦虑、抑郁、注意力缺陷、家庭冲突这些更深层次问题。如果孩子已经出现了严重的心理或者行为问题,您该去看医生还是要去看医生。

但是 Vibe Coding 能够解决另外一个非常关键的问题:它能够把一部分沉迷数字反馈的孩子,转换向能够用数字工具创造东西的孩子。向这个方向转换,这件事的价值还是非常巨大的。

纳瓦尔在这个播客里也说了,Vibe Coding 可能会把能够构建应用的人,从人口总数的 0.1%,提高到 1%、2%,甚至是 3%。注意,这里并不是说所有人都会变成程序员。他说可能未来人口里的 3% 会成为程序员。对于大多数人来说,电脑仍然是一个黑箱。但是对于那些有创造力、有自驱力、有表达能力、有清晰愿景的人来说,门槛就降低了。

所以我们也希望自己的孩子未必能够成为一个各方面都强的人,但是在 AI 时代,他一定要成为一个有创造力、有自驱力、有表达能力、有清晰愿景的人。这个非常重要。这就是我们今天的关键。

一个网瘾少年,如果只是沉迷游戏,他的数字能力可能就被锁在游戏的虚拟世界和游戏规则里。但如果他沉迷的是 Vibe Coding,他至少有机会进入 3% 的应用构建人才里去。他不一定会成为职业程序员,但是可能会成为一个会用 AI 做工具的人。我们是要让孩子从被软件控制的人,变成能够指挥软件的人。这才是 Vibe Coding 替代网瘾的真正意义。

所以,如果您觉得家里的孩子稍微有点网瘾,可以让他接触 Vibe Coding。但是你不要说:“人家 Vibe Coding 都去做什么什么东西,你也要去做同样的东西。”这个就没必要了。一定要让他自己找到他自己的兴趣。

比如说:

重点不是这个项目有多大。大家注意,一开始如果项目大了,他可能就没兴趣了。重点是要让他得到正向反馈,让他体会到一次:“原来我不只是能玩别人的东西,我自己也能做出东西来。”这个转换很小,但是方向完全不同。

如果一个孩子连续几天都愿意花时间改自己的小项目,哪怕还是坐在电脑面前,这已经是从无意识地刷短视频、刷游戏,到自己去创作了。因为他开始有目标了,有目标就要有计划,他就会开始有一定的自控力。

当然,家长也要注意,不要把 Vibe Coding 又当成新型的鸡娃。一上来说:“你看别人家怎么怎么样了,你去参加个比赛,咱们去创个业吧。”这事就废了,你又把兴趣毁了。所以最好的方式是什么?让孩子玩起来,只是这次玩的东西是创造工具。

纳瓦尔是个印度人,移民到美国以后,自己先去创业,然后开始做投资人。他创业的时候,跟他的投资人发生过一些诉讼,他觉得里头有一些条款有问题。所以他后来去做投资人的时候,做了一个项目叫 AngelList,叫天使列表,专门帮助创业者跟投资人建立联系的平台。

他投中的项目包括 Twitter、Uber、Yammer。Yammer 后来被微软收购了。然后是 Stack Overflow,已经上市了;Notion 也是他投的。所以这是一个非常成功的传奇投资人。投资人怎么叫成功?就是你看他投的项目到底都是什么。为什么老范自己老说,我吹牛说我投过 Musical.ly,现在是 TikTok。这种成功退出的,或者说能让大家知道的案例,就是一个投资人身上的标签。他身上有 Twitter,有 Uber,有 Notion,这些公司有的上市了,有的被收购了。

他还讲了些什么?第一个,他讲苹果完了。这个特别有意思。为什么?你想,他现在想着谁都可以写自己的程序。那写完程序以后会发生什么事?大家知道吗?你要上架,你要让 iOS 能够认你这个 App。但是 iOS 上 App 这个事要求是非常严格的。

在这点上,苹果有点像 Costco,叫开市客。大家想想开市客有什么特点?它的 SKU,或者说商品的品类特别少,但是所有商品都是精挑细选、经过选择的。那么大家为什么愿意上 Costco 去交会员费?因为人家替你选过了,你不需要再去挑了,这都是最好的。

苹果实际上一直走这样的策略。它的硬件确实设计得很好,它整体的软件体验也非常好,要比安卓好很多。但是现在好了,大家每一个人都可以写应用了。你要还按这样的方式去做就不行了。我们每个人都有应用,每个人都需要上架,每个人可能都需要在小范围内进行分发。这个时候我们就不需要 Costco 了,我们这时候需要什么?我们需要淘宝。

淘宝是什么?叫只有你想不到的,没有它不卖的。即使它真的不卖,你还可以找商家定制。你现在还可以让 AI 给你定制。所以以后苹果就没有任何意义了。他说苹果这种靠维持 App Store 垄断的生意肯定做不下去了。以后的手机是什么?就是显示器、电池、处理器、存储、摄像头、各种传感器、麦克风,再加上网络连接,其他就都不需要了。我不需要你去替我做这种筛选。我自己做了一个 App,我自己用就行了。你不要上来说“我要为了你的安全”,我不需要,我自己就足够安全了。所以他觉得苹果已经完事了,现在已经到高峰了,再往前涨涨不动了。

他在这个播客里还有一个比较有意思的观点,就是纯软件项目以后就不值得投资了。这个观点也是非常刺激的。原因也很简单,做软件的门槛实在太低了。任何一个人,包括原来这个行业里的产品经理,或者一些文科生,也可以做出软件来了。

他说他以后要去投硬件,投网络效应。就是说你做了一个事情以后,可以进行这种裂变,一传十、十传百,这种事情他要投。数据优势,这个数据只有你有,其他人没有,这个事是值得投的。分发渠道,你可以触达用户,这事可以投。AI 模型能力、品牌、社区、现实世界资源,以及难以复制的系统能力,这些东西是值得投的。纯软件就不投了。

那么 Vibe Coding 到底能不能替代大型软件公司?我只能说,至少到目前为止还不行。现在 Vibe Coding 还是只能做个人工具、小团队工具、原型、内部的一些小系统、学习项目、兴趣项目或小范围应用。

但你说我想做一个为几百万用户服务的,涉及支付、安全、隐私、稳定性、合规、性能、灾备等等一大堆系统的完整项目,也用 Vibe Coding?现在苹果不是也 Vibe Coding 了吗?但是你还是需要有职业程序员,要组队去进行 Vibe Coding。完全不懂计算机的人去搞这个事,是搞不起来的。

但是这也只是当前状态。大家要想想,3 年前我们可能连 AI 到底能不能代码补全还心存疑虑;两年前我们知道 AI 可以做代码补全了,但是应对完整项目到底行不行,我们不知道;去年开始有 AI agent 了,你可以稍微处理一点完整项目了,但是我们还是要在浏览器里看代码的;到今年,已经发展到 Claude Code,发展到 Codex,我们可以不用看代码了。

去年我还不太敢去用自己不熟悉、不会的编程语言写程序。我现在已经可以完完全全使用我从来没有学过、也不看代码、也没见过代码的编程语言去写程序了。所以每一天都在发生变化。现在这种特别复杂的项目,依然需要职业程序员,甚至是成建制的职业程序员使用 Vibe Coding 工具去写。是不是再过一年,普通人也可以一拍脑袋把这事情搞定?这个事我不知道,可能行,但是也可能不行。

AI 时代,个性化软件一定会大爆发,手机可能就会变成一个基础硬件。有一点,我跟纳瓦尔的观点是不一致的。编程人口,他认为会达到 3%,这对于他来说已经是很夸张的一个数字了。但是我个人认为,编程人口有可能会像汽车驾照一样,达到社会人口的一半甚至以上。

中国到现在为止,18 岁以上的人有驾照的是 49%;日本大概是 70% 多;美国 18 岁以上有驾照的人是 85%。如果纳瓦尔的判断是对的,就是非常低的比例会成为程序员,那么你现在去学习 Vibe Coding,这个价值就会上升,因为你可以有敲门砖,可以赢在起跑线上。

如果我判断是对的,以后可能有 50% 以上的人都是程序员,那你就更要去学 Vibe Coding 了。因为你不会 Vibe Coding,不会编程,就相当于现在不会开车似的,你缺乏了一个基本的生活技能。不管是谁对,学 Vibe Coding 都是一个正确的事情。

最后的结论是什么?以毒攻毒,用 Vibe Coding 治网瘾,也许就是 AI 时代的一个新选择。这就是咱们今天节目的核心观点。不是 Vibe Coding 要替代程序员了,也不是说孩子学了 Vibe Coding 就一定会发财,更不是说 Vibe Coding 是医学意义上的网瘾治疗方案。

我真正想说的是,在 AI 时代,我们也许可以用一种更高阶、更有现实生产力的数字成瘾,去替代一种低阶的、纯消费的、被算法控制的数字成瘾。

区别就在于,游戏的奖励大多是留在游戏的虚拟世界里了,而短视频的刺激更是什么都没剩下。Vibe Coding 的奖励是一个真实的作品、一个页面、一个小工具、一个 App 原型。这些才是真正有价值的东西,也是让孩子快速进入 AI 时代、快速进入程序时代的一个敲门砖。咱们不说什么赢在起跑线上这些比较垃圾的话,这就是咱们今天讲的故事。

2026-05-11 09:12:19

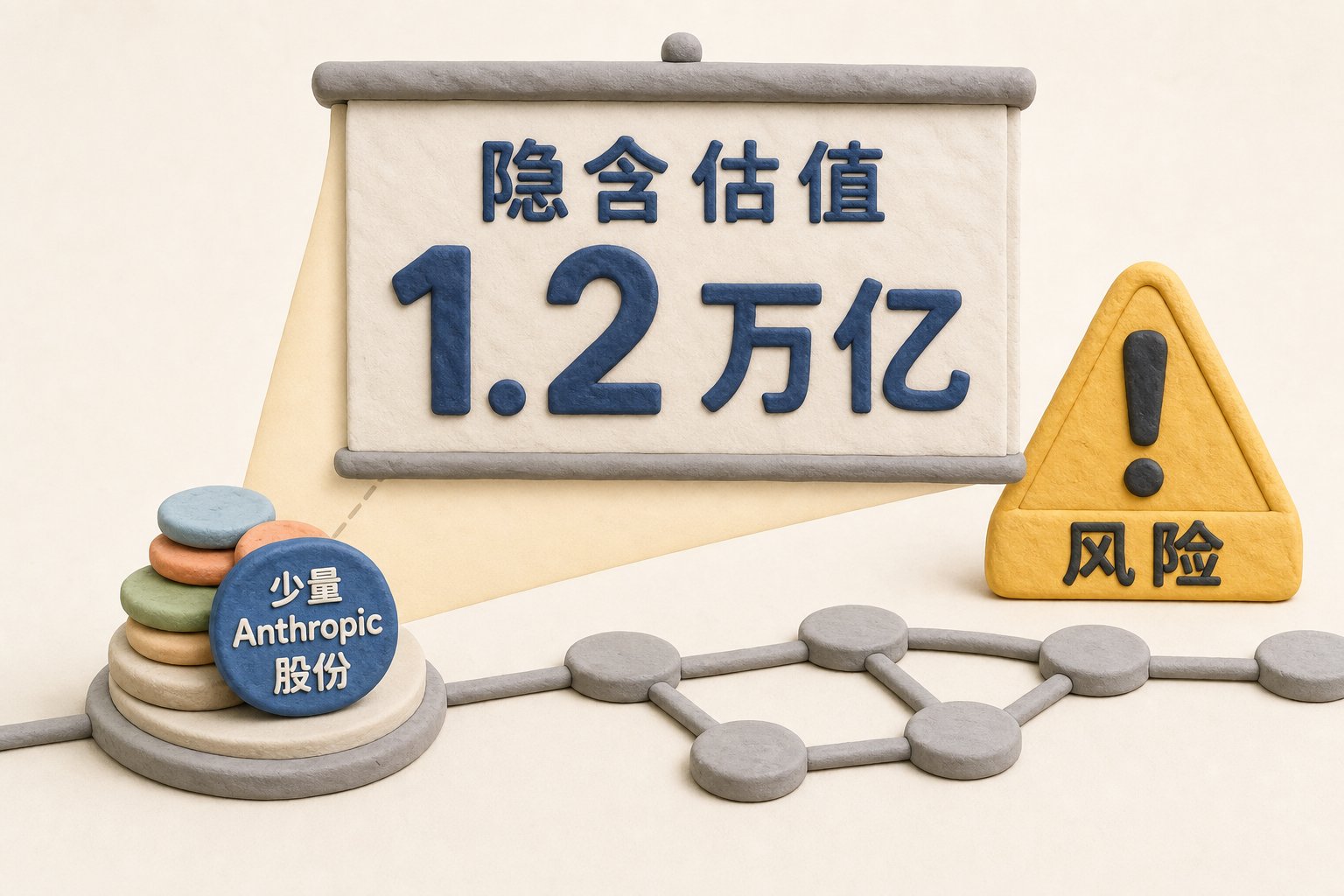

关注 AI 领域的朋友们,最近应该经常被一条新闻刷屏。这个新闻的标题叫做:Anthropic 的 Pre-IPO 估值已经冲到了 1.2 万亿美金,超越 OpenAI,成为全球估值最高的 AI 公司。

这个标题确实非常抓人,因为里面有 Anthropic、OpenAI、Pre-IPO、1.2 万亿美金这些关键词。全球市值第一的 AI 公司上市前暴涨,普通人要提前买入。如果只看标题,你会以为 AI 界已经变天了:OpenAI 已经不是老大,Anthropic 现在是老大了。

1.2 万亿美金这个数字本身很容易引起误导。所以今天不着急喊 Anthropic 好厉害,也不是出来喊哪里有泡沫,而是把它拆开以后,把这里面的三个误导和一个风险说清楚。

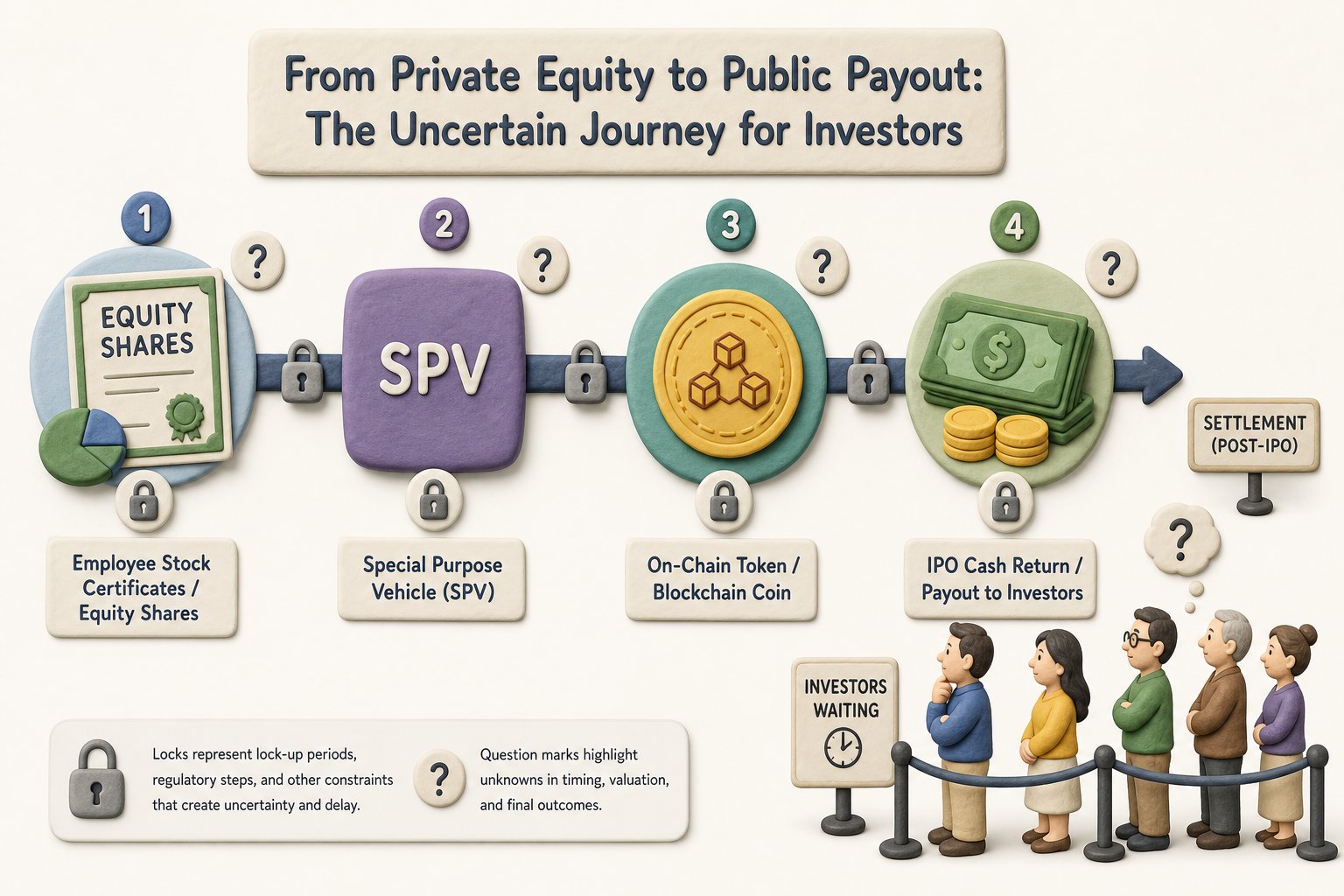

很多中国人对 Pre-IPO 这件事特别有执念。什么叫 Pre-IPO?就是 IPO 之前融的最后一轮钱。

为什么中国人对这件事特别有执念?因为中国 IPO 长期是审批制,不是注册制,所以 IPO 的机会很少。最后一轮上车的这帮人,也就是 Pre-IPO 这一轮的人,通常会代表一些官二代、红二代、富二代,他们上车以后会给你保驾护航,能够让你上市成功;上市以后,他们也能挣到超额回报。因为上市机会少,谁上去了以后就属于“奉旨割韭菜”。

所以 Pre-IPO 在中国有一个很特殊的意义。但是这里要讲的第一层误导就是:此 Pre-IPO 非彼 Pre-IPO。

正常应该是上市之前最后一轮融资叫 Pre-IPO,但是 Anthropic 这个 Pre-IPO 叫做链上 Pre-IPO,是一种跟区块链相关的特殊股票计价方式。

有人把这种 tokenized 的 Pre-IPO 当成了真正买到了 Anthropic 股票。这个还不行。你买到的这种 token 化股票,实际上是一个价格敞口,跟最后你真正买到股票不能直接画等号。

很多人会把这种二级市场上的小盘交易价格,当成 Anthropic 上市时一定能够兑现的市值。这是有区别的。

现在 tokenized Pre-IPO 这个盘子非常小,可能只占到千分之几的份额。这个数据的涨跌,跟 Anthropic 自己的估值或者最后上市的市值,其实并没有什么直接关系。而且这种从 tokenized Pre-IPO 的价格反向传导回它的估值、它的市值,这个链路并不通畅。

这就是三重误解。

那么风险是什么?这些 SPV,也就是以特殊目的建立的基金或者公司,一般什么时候会玩这个东西?比如说想买 Anthropic 股票,但现在它没上市,买不着。那怎么办?有些人说,我们替你买。我们专门建一家公司,去买 Anthropic 股票。Stockx 每过一段时间也会卖一些老股。

如果你是个人,手里只有 20 块钱买菜钱,也想买这个东西,你买不着,人家不跟你谈。现在就有人说,我成立一个基金,我去投资,我去买它的老股,然后你再给我 20 块钱,我把这个东西拆开以后分你一部分。这个就叫 SPV。

有些人把 SPV 的东西代币化,到链上去交易,这就是今天讲的 tokenized Pre-IPO。

但这些东西 Anthropic 得承认才行。也就是说,Anthropic 承认他们买走的这些股票,到上市的时候都认,最后愿意给你兑现,这才可以。但是现在 Anthropic 有可能不承认。

它已经发公告说,我们现在是私营公司,我们没上市,所有对我们公司股票的转卖,必须要经过我们同意;没有经过我们同意的,我们通通不承认。

那你说,人家愿意买你股票,你凭什么不承认,凭什么不同意?这个其实很好理解。Anthropic 也有竞争对手,也有一些人是 Anthropic 不希望把股票卖给他的。比如背后是中国国资的一些基金,也想冲上去买 Anthropic 股票,那 Anthropic 会说,我必须审核一下。你卖给谁之前,必须告诉我;如果我不知道你就把股票卖了,这件事我有可能不承认。

如果它已经上市了,比如哪天 Anthropic 在纳斯达克上市,有国资基金冲上去说我们要买股票,它是不能反对的。但没上市之前,它是可以反对的。所以这里面有一个重大风险。

先把事情讲清楚:这 1.2 万亿到底是从哪来的?我们先不要被 1.2 万亿美金这个数吓着。这个数字不是 Anthropic 官方宣布的,也不是 Anthropic 最新融资爆出的估值。

像这种没上市的公司,它的估值一般有几种方式对外暴露。

上市以后才有市值,没上市之前通常只有这三种方式暴露估值。

这一次暴露的叫链上 Pre-IPO 市场的隐含估值。简单来讲,就是有人通过 SPV 的方式得到了一部分 Anthropic 的股票,而且这个股票的数量其实很少,还存在巨大风险:Anthropic 有可能不承认。他们把这一部分 Anthropic 股票上链交易去了,完整的名字应该叫 Anthropic tokenized stock。

交易 Pre-IPO 的这个公司叫 PreStocks,是 2025 年才创建的。现在在这个平台上交易的有 Anthropic、OpenAI、Neuralink、SpaceX,这些公司都没上市。但是比如通过投资、购买、买老股的方式,他们得到了一点点股份,然后放在这里,谁愿意买谁去买。

这里面就不再管你是谁了,只要你拿着比特币,或者 USDT、USDC,就可以来买,直接跟你交易。既然有交易,它就会有一个市值出来。所以这一次的价格就是这么来的。

要注意,它叫隐含估值。所谓隐含,就是它不是一个官方估值,也不是公司董事会批准的融资价格,不是审计以后的市场价值,也不是 IPO 定价,跟这些通通都没关系。而且这个价值想要传导回去,说“我这边已经 1.2 万亿了,我要影响 Anthropic 本身的定价”,基本上没有什么路径。

Anthropic 的官方估值到底是多少?要注意,它已经 close 的融资是在 2026 年 2 月份,300 亿美金到手。那一轮已经关闭了。只有已经关闭的交易,才可以算它的估值是多少。你说现在还谈着,还有一些交易没做完,协议没签,钱没到手,这个是不能算的。

按照 2026 年 2 月份这一次 300 亿美金的融资,它的估值是 3,800 亿美金 post-money,也就是投后估值。

你说这跟 1.2 万亿差远了,差三点几倍,快 4 倍了,这数对吗?对,这就是官方确认的 3,800 亿美金。

再往后还有没有在谈的融资?有。现在还有一个 500 亿美金的融资还在谈,也就是说这一轮要进 500 亿美金现金。它这一轮的投后估值,现在大家猜测是 1 万亿美金。但是在没有签字、没有对外公示之前,这都是无效的。

所有谈融资,都要签 term sheet,也就是投资意向书。投资意向书里有一个很关键的点:保密。所以在正式投资文件签署之前、对外公开之前,没有任何一个严肃的投资人会来跟你讲说,我准备投多少钱,这个估值是多少。这个都不对。一旦说了这个数,就违反了投资意向书的保密义务,就会被踢出局。这个事是不能说的。

所以它到底是不是到 1 万亿美金了,我们要等。等它这个 500 亿美金这一轮融资完成,大家签了字,正规媒体出来报道了,我们才能说它的价值在往上涨。

所以 Anthropic 目前正常的估值是 3,800 亿美金。这里面有三个数:

这三个价格,大家要理解清楚。

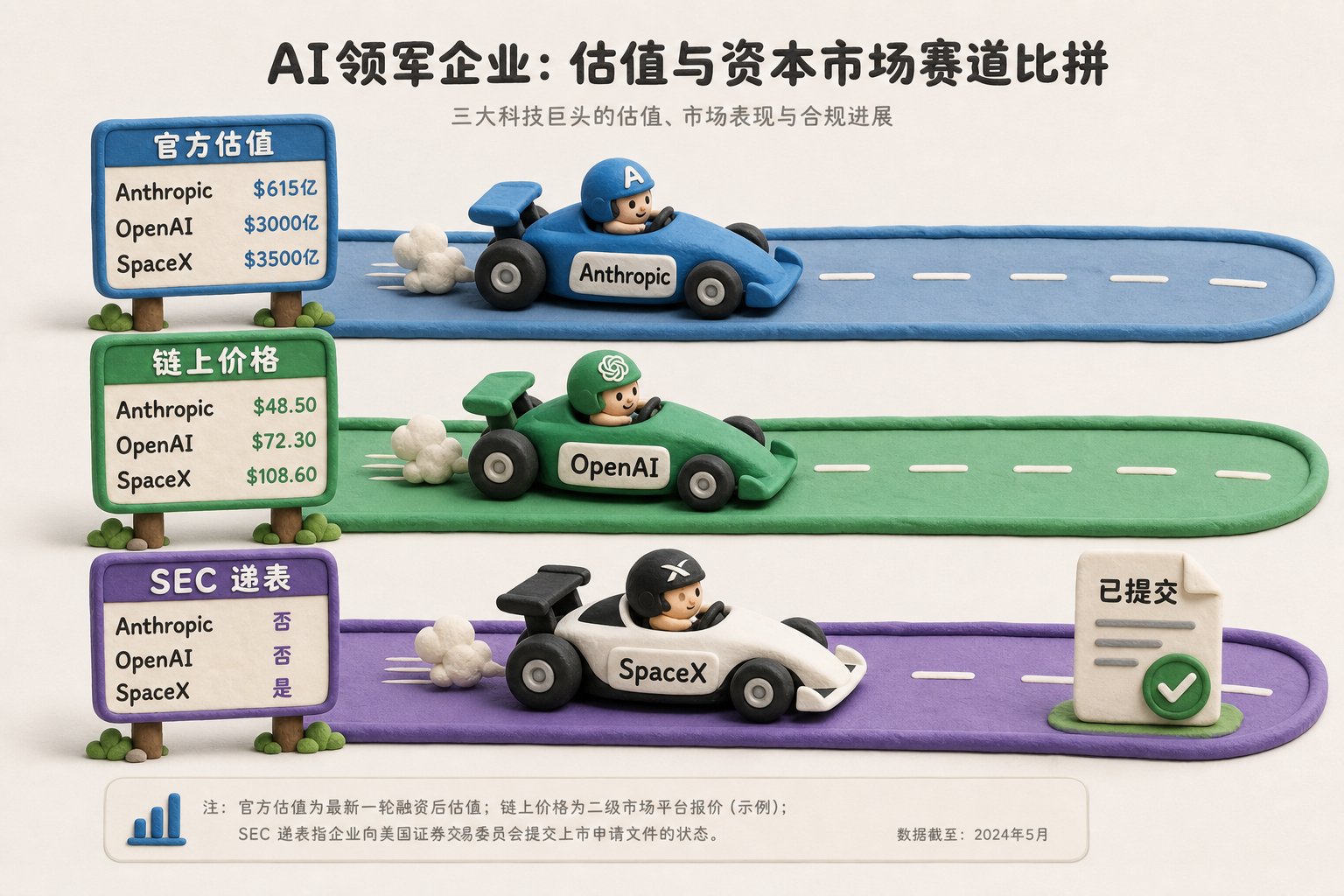

那讲到这里,OpenAI 值多少钱?到底有没有被超过?

OpenAI 在 2026 年 3 月份也完成了一轮巨额融资。这一轮融资以后,它的估值达到了 8,520 亿美金 post-money,也就是投后估值 8,520 亿美金。所以从可以确认的估值上来说,OpenAI 还是 Anthropic 的两倍多:OpenAI 是 8,520 亿,Anthropic 是 3,800 亿。

那 OpenAI 有没有 tokenized Pre-IPO 的估值?也有。PreStocks 这个创业企业也拿了一部分 OpenAI 的股票上链,让大家去交易。在那个上面,现在 OpenAI 的价格大概是 1.3 万亿美金,比 Anthropic 还要稍微贵一点点,但是已经非常接近了。

这种价格代表的是一种心理预期。虽然它很难反向影响到实际公司的价值,但是它还是代表着能够参与这种交易的人对这两家公司的价值认可。

那 SpaceX 现在在 PreStocks 的 Pre-IPO 上价格是多少?大概是 1.8 万亿。这三家公司都号称今年要上市,但是现在真正向 SEC 递表、交了 S-1 上市申请书的只有 SpaceX。

SpaceX 说我们准备按 1.75 万亿去招股,这是一个确定的数字,不是大家随便拍脑袋出来的数字,这是 SpaceX 已经交上去的数字。

剩下两家,OpenAI 和 Anthropic 到底什么时候交表,现在不知道,并没有确定消息说它们已经把表交到 SEC 了。所以对它们来说,正规的 Pre-IPO 压根还没开始做。最后 IPO 之前的那轮融资才叫 Pre-IPO。

而且在美股上,Pre-IPO 并不像在 A 股上这么神秘,大家都可以上去搞。而且 Pre-IPO 的投资还会受到一些限制,比如锁定期。不是说上市之前冲进去,上市以后就可以马上割韭菜。正常 Pre-IPO 投资在上市以后并不能马上卖掉,还要锁定一段时间才可以卖。

那为什么 Anthropic 会炒到这么高?大家是不是真的觉得 Anthropic 已经接近甚至要超过 OpenAI 的价值?

Anthropic 最近一段时间确实很猛。一方面,它的编程模型 Opus 4.6、Opus 4.7 确实很强。虽然 OpenAI 的 Codex 以及 GPT-5.5 能力提升很快,而且 OpenAI 的 Codex 和 GPT 其实要比 Anthropic 便宜很多,解决同样的问题,这边花的钱要比那边少很多。即使在这样的情况下,大家依然认为现在最好的编程模型,最好的真正能够干活而不仅仅聊天的模型,还是 Anthropic 的。

而且 Anthropic 背后是谷歌和亚马逊。它可以证明谷歌云很强,亚马逊云也很强,谷歌的 TPU 很厉害,亚马逊自己做的芯片,包括上面买的英伟达芯片都很强。它这块的通用性很好。谷歌和亚马逊又是它的大股东,也非常愿意顶着它继续往前走。

对于云计算厂商来说,支撑一个这种顶级大模型公司前进是有巨大好处的。为什么?不是说我们买了 token,Anthropic 上谷歌云、亚马逊云交钱就完事了,而是比如我今天想买一个云服务,因为我后面要使用 Anthropic 的 AI 服务,所以我愿意把它部署在谷歌或者亚马逊云上。因为离服务器近,不用出机房就可以找到 Anthropic 的 AI 服务,成本会急剧下降,效率会急剧上升。这对于它们自己卖云计算服务是有巨大好处的。

还有一点,Anthropic 现在真正比较强的地方在于,它算是引领了时代。在这个行业里,现在到底谁挣了多少钱,谁有多少用户,重要吗?重要,但并没有那么重要。真正重要的是谁代表了先进生产力,谁代表了未来的方向。

现在大家玩的这一波叫做 Harness agent,也就是驾驭系统。这一波是从哪里来的?就是从 Anthropic 的 Claude Code 这里来的。现在大家都在围绕这一套东西往前走,包括 OpenAI 的 Codex,还有国内很多类似产品,都属于 Harness agent,也就是驾驭系统,都是从 Anthropic 这边来的。

而且现在大家去看 GitHub,每周最抢眼、star 涨得最多的开源仓库,通通都是围绕 Claude Code 和 Harness agent 的。这就说明这就是今年的方向了,所以这一块确实很猛。

现在还有一个问题是,Anthropic 号称要上市。现在要上市的这三家,SpaceX、Anthropic 和 OpenAI,SpaceX 这事基本上确定了,已经交表了,等就好了。

而 OpenAI 麻烦缠身,一边还跟马斯克打着官司,山姆·奥特曼又是一个财务纪律非常涣散的人。IPO 不光是说可以上市割韭菜,IPO 必须要守一大堆规矩。因为一旦 IPO 以后,大家就再也没有优先股了。

什么叫优先股?就是除了有股票的标准价格和权利之外,还有一些优先权,这个东西叫优先股。因为一旦上市,所有优先股通通变成普通股。不能说谁的股票比谁的股票权利更多一些,这个事是有问题的。当然投票权可能会有差异,但是别的权利都是一致的。你说我这个股票给你的分红权比别人的股票多一些,这不行,这样外面买你股票的人就亏了。

所以一定要一致。当所有人都拿着普通股时,就需要靠一套很完善的规则来管理公司。股市会保证这些公司都符合一个基本规则去运转:我买了它的股票,它就不能骗我,不能做假账,挣了钱得跟我分。这些规则是要保证的。

而山姆·奥特曼本身不是一个特别守规矩的人。他自己的 CFO 也认为,他经常有一些大嘴巴,或者有一些财务上不是那么守规矩的地方。所以 OpenAI 到底什么时候能上市,不知道。

Anthropic 一直相对来说还是比较规范的,而且挣钱也是老老实实在挣。它说我要上市了,大家就相信它真的能上市,而且上市以后还能涨很多。现在也就是 3,800 亿,如果这个时候能冲进去,等它上市的时候一定能挣很多。所以大家会有很强的 FOMO 情绪。

什么叫 FOMO?就是 fear of missing out,害怕错过的感觉。大家会想,我们能不能提前上车?等上市以后股票开始涨了我再去买,这不就亏了吗?能不能在它没上市之前就冲进去?于是大家就会研究怎么冲上去,怎么上这个车。现在 PreStocks 这个公司就拿出了这样的产品,叫做 tokenized Pre-IPO,很多人就会冲上来买它,把这个价值冲得很高。

三个误导和一个风险已经讲过了,再补充一点知识:如果你今天买了这些代币,上市以后怎么办?

它叫 tokenized Pre-IPO,那 IPO 以后怎么办?首先要说一点,PreStocks 这个创业项目非常年轻,2025 年才创建,所以到目前为止,它没有成功退出过任何一个项目。没有哪个项目说,我把 Pre-IPO 的 tokenized 卖掉以后,它成功上市了。这个事并没有发生过,所以这里面还有很大的不确定性。

理论上说,它应该是在 Pre-IPO 这个点上,把原来寄存在它这里的这些 SPV 权益首先送到股市上去。

比如这里有一个叫张三的 Anthropic 员工,手里分到了一部分 Anthropic 股份,然后他偷偷把这个股份卖给了一个 SPV。这个 SPV 把这一部分股份 token 化,送到链上交易。等到 Anthropic 上市了,张三自己把这个股票登记到自己身上,因为他是员工,然后再跟这个 SPV 做交割,说我把这部分再交割给你。它已经上市了,你可以到那边去买,或者做相应处理。他是可以做这样的操作的。

SPV 要在满足所有限制条件以后,把这些股票卖掉变成现金,然后再把这些钱还给原来买 token 的人。它大概是这样的一个流程。

有人问,交割的时候,也就是 SPV 买这个股票的时候,直接登记不就完了吗?问题就在这儿:Anthropic 不承认。你去登记,也要有人承认才行。所以大家实际上签的是个白条,或者不是一个特别正规、可以被认可的协议。

所以这个钱你现在交了以后,怎么把它变回来,这个过程可能会有一定不确定性。

说一个比较小概率的事件。比如在临上市之前,张三被开除了,他所有授予的股票都直接被没收了。那你在这交易了半天,这个东西就是一张废纸。这个可能性也是存在的,所以这就是一个重大风险。

最后重新数一下三个误导。

最后要注意的风险是,这些 SPV 和代币化的敞口,是 Anthropic 官方不承认的。以前我们投资项目的时候,最后要签协议,所有相关股东都要签协议。有一个股东不签字,整份协议就失效。

今天这个故事,其实就是第一个误导的重要性。你说 1.2 万亿美金估值这件事完全是空穴来风、完全是假的吗?也不是。只是这里面有很多信息被隐藏掉了,没有跟大家对齐。所以今天把这个事情稍微对齐一下,希望大家能够对 OpenAI、Anthropic 有一个更理性的看待。